医学分割 不确定性 2019 MICCAI

z今天分享一篇发表在MICCAI 2019上的论文:

Uncertainty-aware Self-ensembling Model for Semi-supervised 3D Left Atrium Segmentation

https://www.cnblogs.com/CZiFan/p/13180440.html

1 研究背景

训练网络 大量标签数据, 然而 分割任务 标注成本高,因此 半监督方法。

这篇文章针对3D MR图像的左心房分割任务 提出了不确定性感知自增强模型,有效地利用无标签数据。

1. 对于有标签数据,学生模型 (student model)进行有监督学习。

2. 对于无标签数据,通过教师模型 (teacher model)预测分割图,作为学生模型 (student model)的学习目标,并同时评估学习目标的不确定性。

3. 基于学习目标的不确定性,采用一致性损失函数提高学生模型的性能。

采用了指数移动平均 (exponential moving average, EMA)策略来提高教师模型的预测结果

2 方法

1. 半监督分割 (Semi-supervised segmentation)

监督损失部分(交叉熵损失)Ls+Lc 教师模型和学生模型之间的无监督损失部分

2. 不确定性感知 (Uncertainty-Aware Mean Teacher Framework)

教师模型对于无标签数据的预测结果是不确定性且有噪声的,而这些预测结果将作为学生模型学习的一部分(Lc)。

因此作者设计了不确定性感知策略使得学生模型能够逐渐学习更加可靠的目标。

具体地,对于训练图像,教师模型不仅要预测它们的分割图,还要评估它们的不确定性。

然后学生模型在学习中只选取其中具有更低的不确定性(更加可靠)的数据计算一致性损失 (consistency loss)。

2.3.1 不确定性评估 (Uncertainty Estimation)

不确定评估是由教师模型生成的,具体有:

1. 对于每一个输入数据,进行 T 次前向传播获得预测结果,每一次都随机对输入数据加入高斯噪声或者在网络中加入随机dropout。因此每一个体素都有 T 个预测结果,可以表示为『Pt』t=1T

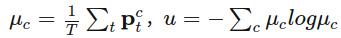

2. 采用预测熵 (predictive entropy)大致近似不确定性

Ptc表示对在第 t 次前向传播中对属于第 c 类别概率的预测,最终可以构成一个不确定性张量 U,『u』的集合。

先算出T次向前传播后的预测值,然后使用了一个信息熵公式求出不确定性

2.3.2 基于不确定性的一致性损失函数 (Uncertainty-Aware Consistency Loss)

有了上一步的教师模型预测的不确定性结果U,可以过滤掉相对不确定的预测,而选取相对可靠的预测作为学生模型的学习目标。

最新文章

- python之路:Day04 --- Python基础4

- checkbox实现互斥

- 安装SQL SERVER开启SA用户登录的方法

- SHELL脚本攻略(学习笔记)--2.5 tr

- 【贪心】 BZOJ 3252:攻略

- TCP/IP 协议理解

- javascript字符类型操作函数

- 你必须掌握的Java基础:JSON解析工具-json-lib

- IIS7伪静态化URL Rewrite模块

- 第一百一十七节,JavaScript,DOM元素尺寸和位置

- 获取客户端IP地址经纬度所在城市

- JavaMail 邮件开发

- JVM堆内存监测的一种方式,性能调优依旧任重道远

- Redis Keys的通用操作

- 【清北学堂2018-刷题冲刺】Contest 2

- 关于java11 - 应该知道的

- 数据库-mysql语句-查-WEB服务器

- UML和模式应用4:初始阶段(5)--用例编写的准则

- FAT16/32不等于ESP:windows安装程序无法将windows配置为在此计算机的硬件上运行

- 最小生成树kruskal模板

热门文章

- Chrome浏览器提示您的连接不是私密连接解决办法

- 2023-03-02 TypeError: null is not an object (evaluating 'ImageCropPicker.openPicker')

- Zabbix源码安装与yum安装

- (0821) git 下拉code不稳

- iis发布后设置文件夹用户安全权限

- 日記かな、自分のサーバ作りの?(01、try…catch…の問題)

- debian11下载软件包及依赖(本地使用)

- iras point sources

- ObjectARX2016-1打印HelloWolrd

- IDEA通过Spring Initalizr新建SSM (2)