深度学习——RNN

2024-09-04 06:47:25

整理自:

https://blog.csdn.net/woaidapaopao/article/details/77806273?locationnum=9&fps=1

- 原理

- RNN、LSTM、GRU区别

- LSTM防止梯度弥散和爆炸

- 引出word2vec

1.原理

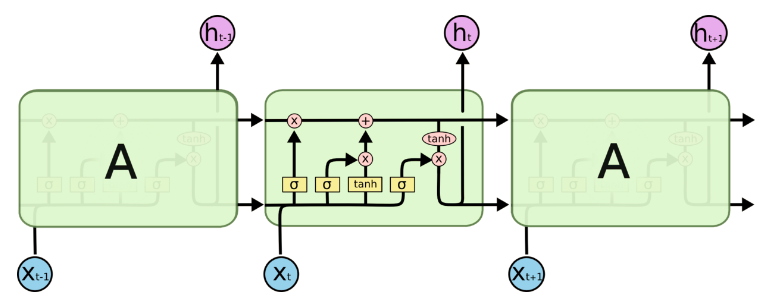

在普通的全连接网络或CNN中,每层神经元的信号只能向上一层传播,样本的处理在各个时刻独立,因此又被成为前向神经网络(Feed-forward+Neural+Networks)。而在RNN中,神经元的输出可以在下一个时间戳直接作用到自身,即第i层神经元在m时刻的输入,除了(i-1)层神经元在该时刻的输出外,还包括其自身在(m-1)时刻的输出。所以叫循环神经网络

2.RNN、LSTM、GRU区别

- RNN引入了循环的概念,但是在实际过程中却出现了初始信息随时间消失的问题,即长期依赖(Long-Term Dependencies)问题,所以引入了LSTM。

- LSTM:因为LSTM有进有出且当前的cell informaton是通过input gate控制之后叠加的,RNN是叠乘,因此LSTM可以防止梯度消失或者爆炸。推导forget gate,input gate,cell state, hidden information等因为LSTM有进有出且当前的cell informaton是通过input gate控制之后叠加的,RNN是叠乘,因此LSTM可以防止梯度消失或者爆炸的变化是关键,下图非常明确适合记忆:

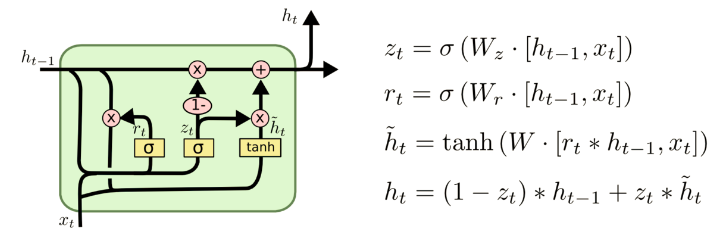

- GRU是LSTM的变体,将忘记门和输入们合成了一个单一的更新门。

3. LSTM防止梯度弥散和爆炸

LSTM用加和的方式取代了乘积,使得很难出现梯度弥散。但是相应的更大的几率会出现梯度爆炸,但是可以通过给梯度加门限解决这一问题。

4.引出word2vec

这个也就是Word Embedding,是一种高效的从原始语料中学习字词空间向量的预测模型。分为CBOW(Continous Bag of Words)和Skip-Gram两种形式。其中CBOW是从原始语句推测目标词汇,而Skip-Gram相反。CBOW可以用于小语料库,Skip-Gram用于大语料库。

最新文章

- laravel框架中容器类简化代码-摘自某书

- TableView分割线从顶端开始

- Maven私有仓库搭建和使用

- 如何知道使用的是哪种shell?

- 《Linux内核分析》第六周 读书笔记

- App软件开发的完整在线流程(一看就懂)

- 实现Android4.4系统设置分页滑动浏览功能

- 【转】关于.net framework4.0以及4.5安装失败,“安装时发生严重错误”……

- new,delete和malloc,free以及allocator<T>

- 常用到的Mysql语句

- acdream1116 Gao the string!(扩展KMP)

- XCODE6 提交至 App Store

- OD: Memory Attach Technology - Exception

- CentOS 七 vs CentOS 6的不同

- Windows Server 2016-Windows Server Backup功能

- kafka集群扩容后的topic分区迁移

- Linux服务-samba

- [ext]form.submit()相关说明

- Bzoj2721 [Violet]樱花(筛法)

- 部署 LAMP (CentOS 7.2),摘自阿里云,方便查看使用