#Week8 Advice for applying ML & ML System Design

2024-10-09 01:05:03

一、Evaluating a Learning Algorithm

训练后测试时如果发现模型表现很差,可以有很多种方法去更改:

- 用更多的训练样本;

- 减少/增加特征数目;

- 尝试多项式特征;

- 增大/减小正则化参数\(\lambda\)。

那么该怎么去选择采用哪种方式呢?

一般将70%的数据作为训练集,30%的数据作为测试集。

先用训练集最小化\(J_{train}(\Theta)\),得到一组参数值\(\Theta\);

然后计算测试集误差\(J_{test}(\Theta)\):

对于线性回归:

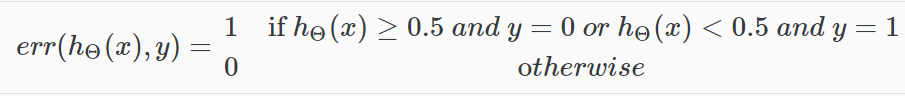

对于逻辑回归:

测试集的平均误差(分类错误的比率):

假设要选择用几次多项式\(d\)去作为假设函数,那么做法就是不断尝试\(d\),选择一个在测试集上损失最小的\(d\),以此作为模型泛化能力的衡量。但是这样是有问题的,因为\(d\)相当于是被测试集训练的,再用测试集去测试,很不公平。所以一般将数据集分为3部分:60%训练集、20%交叉验证集、20%测试集:

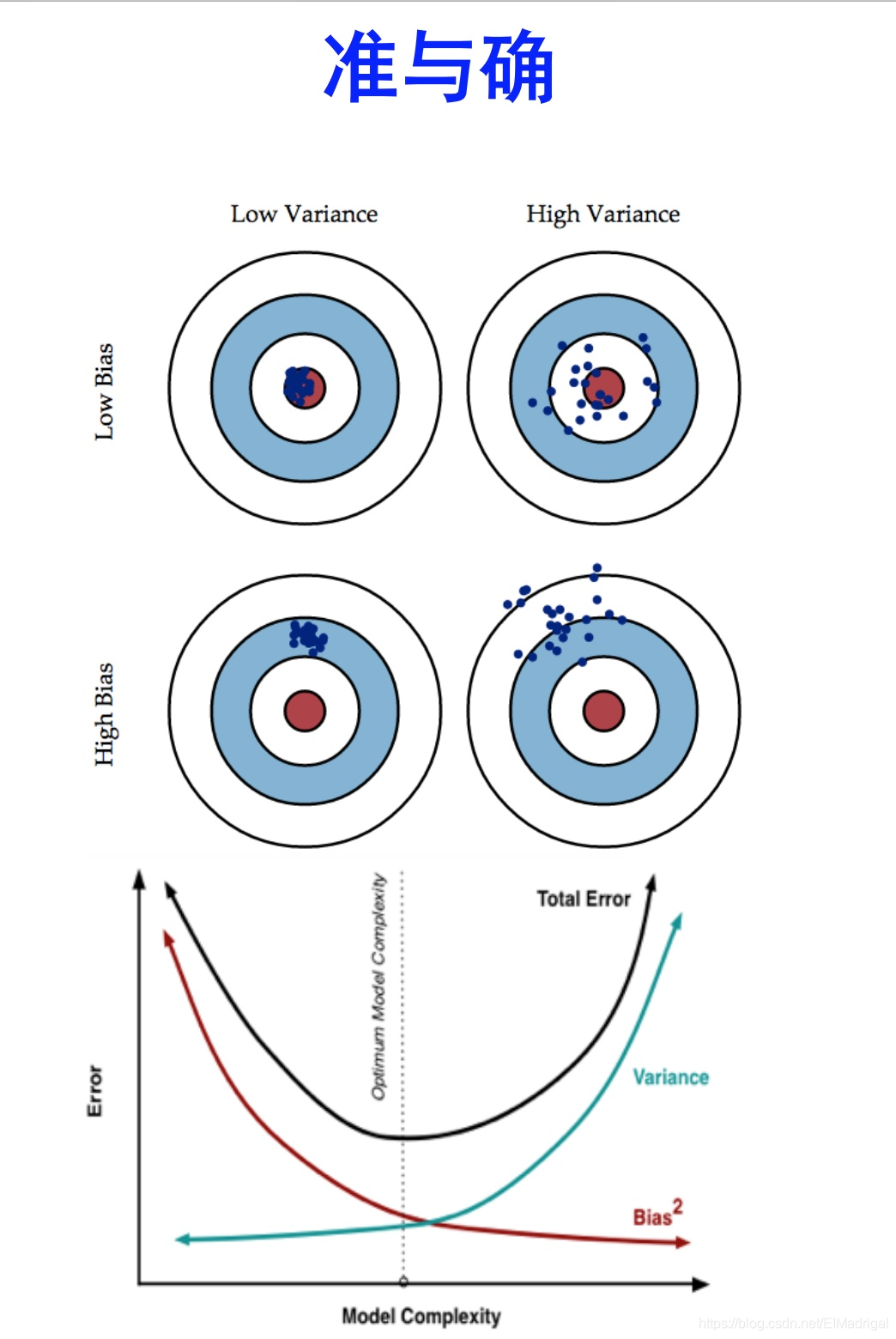

二、Bias vs. Variance

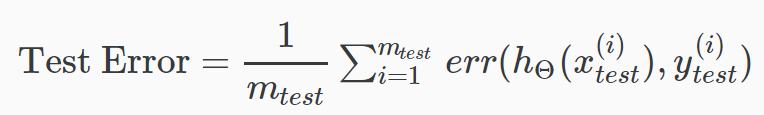

看图:

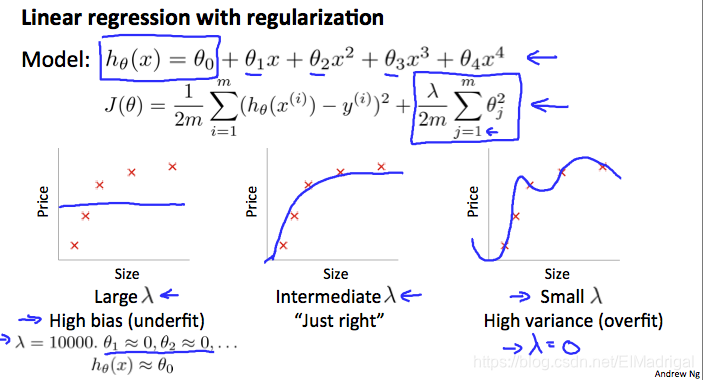

正则化和Bias/Variance的关系:

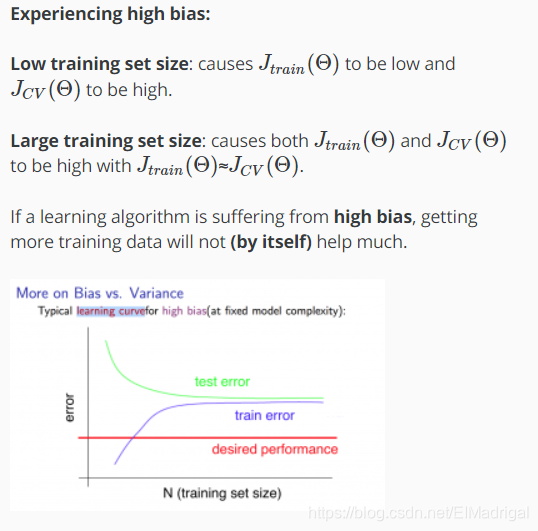

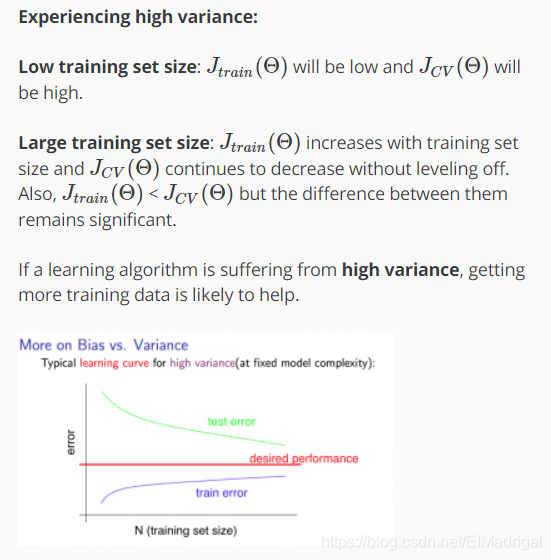

训练集大小与Bias/Variance的关系:

三、Error Analysis

Andrew推荐的流程:

四、Handling Skewed Data

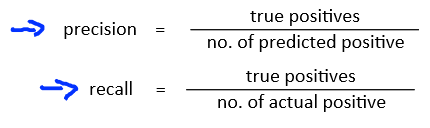

如果数据集中正负类的数据规模差距过大,只用误差衡量模型是不可靠的,此时需要查准率和召回率两个指标。

如何权衡这两个指标,一般使用\(F1\)得分:

\[F_1=2\frac{PR}{P+R}

\]

\]

最新文章

- ERP软件的价格设计

- ngx_http_core_module模块.md

- python sokct 包详解

- MySql之触发器【过度变量 new old】

- Eclipse+pydev 常用快捷键

- Hive 8、Hive2 beeline 和 Hive jdbc

- submit提交表单后,不刷新当前页面

- Jenkins SSH timeout

- 本地phpstudy时常停机连接失败,php.ini文件中9000端口问题

- 2017年总结的前端文章——CSS盒模型详解

- bugku web web5

- 【转载】IIC SPI UART串行总线

- LeetCode刷题:第一题 两数之和

- vue快速入门

- matplotlib fill和fill_between

- vue.js精讲01

- Java中double转BigDecimal的注意事项

- swift 基础小结01 --delegate、Optional、GCD的使用、request请求、网络加载图片并保存到沙箱、闭包以及桥接

- 绝对震撼 10个实用的jQuery/HTML5插件

- 我的JdbcUtils类