spark复习笔记(3):使用spark实现单词统计

2024-10-07 12:02:25

wordcount是spark入门级的demo,不难但是很有趣。接下来我用命令行、scala、Java和python这三种语言来实现单词统计。

一、使用命令行实现单词的统计

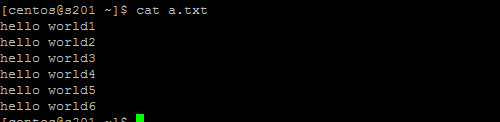

1.首先touch一个a.txt文本文件

2.加载文本:产生弹性分布式数据集,用sc.textFile()加载文本文件到内存中去,加载到内存之后,整个RDD就是一个数组,就以换行符来做分隔

val rdd1 = sc.textFile("/home/centos/a.txt")

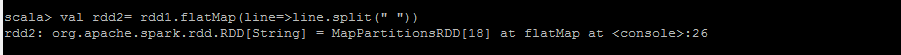

3.对2中产生的数组按空格进行切割,切开之后每个元素就变成了一个数组,[hello,world1]

val rdd2=rdd1.flatMap(line=>line.split(" "))

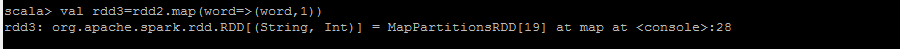

4.对3中产生的结果进行key,value键值对额转换

val rdd3=rdd2.map(wor=>(word,))

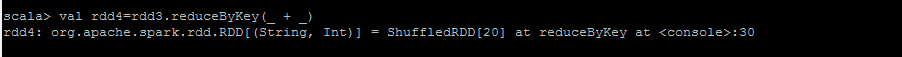

5.对4中的结果进行聚合

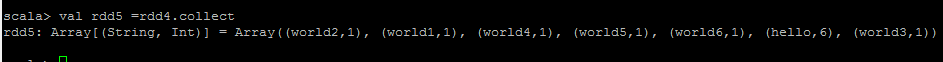

val rdd4=rdd3.reduceByKey(_ + _)

5.查看结果

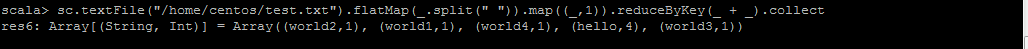

6.一步操作

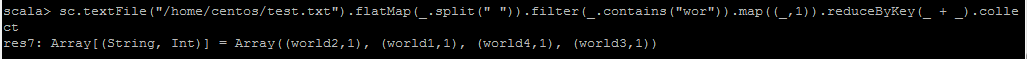

7.实现单词过滤

对于spark-shell这种环境一般只用于测试和调试

最新文章

- 从 AJAX 到 JSONP的基础学习

- socket详解

- 2287: 【POJ Challenge】消失之物

- OPENSSL 学习整理-介绍

- vim 学习日志(3):跳到行尾、行首、文件尾、文件首、加密

- 关于Windows下如何查看端口占用和杀掉进程

- python 中 time 模块 格式化 format

- C++之拷贝构造函数

- 字符串(后缀自动机):NOI 2016 优秀的拆分

- oracle add_months函数的用法详解

- 关于ASP.Net的一些概念 转载

- WebBrowser与IE的关系,如何设置WebBrowser工作在IE9模式下?

- Cousera课程Learning How to Learn学习报告

- Java 集成 速卖通开发.

- Android初级教程XUtils实现“断点续传”下载

- vue2.0的初始化

- Swoole PHP windows composer

- javascript的常用事件

- Db2性能:系统CPU高问题分析的一些思路

- Mac下搭建lamp