【DL论文精读笔记】AlexNet

2024-10-21 03:05:28

1.1引言

1.2数据集

就是ImageNet,当时计算机视觉最大的数据集

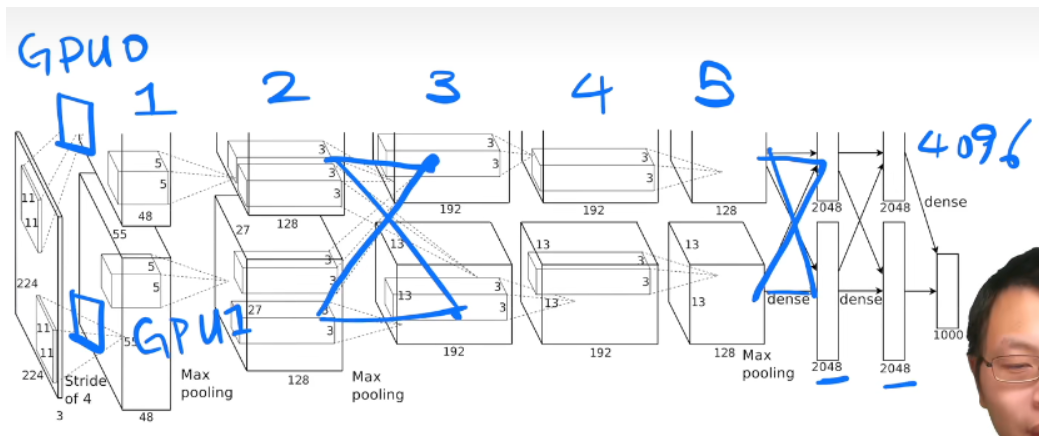

1.3结构

采用双GPU结构实现,并行处理图像,2-3,5-全连接部分中间还将特征图共享

最后全连接层输出的4096的语义信息具有重大意义,为之后的分类等做奠基

1.4.避免过拟合

1.4.1 数据增强

● 把图片人工变大,256x256随机截取224x224出来

● 在通道上做变换,使得颜色不一样

因为卷积对图片的位置、光照、颜色等信息是比较敏感的,做变换之后,记住数据的能力变低

1.4.2 Dropout

作者认为dropout是模型融合,但如今大家觉得dropout是一个正则的东西

如果没有dropout放在前面两个全连接上,实验表明没有dropout过拟合严重

1.5.训练细节

● 使用SGD来训练,momenum

● 权重是使用均值为0,方差为0.01高斯随机变量来初始化

● 2、4、5层偏移初始化为1,其他为0。(然并卵,目前采用全部初始化为0)

● 每个层用同样的学习率,从0.01开始,如果验证误差不往下降,就x10,但是后来不用这个做法,主流做法是每多少epoch下降一点。

Alexnet是蓝色曲线,目前主流算法用平滑的下降方式,比如cos函数则是红色曲线

● 需要5-6天在两个NIVIDIA GTX 580 3GB的GPU训练

1.6.实验

最重要的部分,就是一些数据对比。具体实验怎么做不用太关心细节,看结果

实验在完整的数据集上进行了训练,沐神说现在很少有人去完整的数据集上训练了,但是完整的数据集质量会更好。

重点:

他在两个gpu上训练,发现在gpu1上发现的是与颜色无关的特征,而gpu2则是颜色相关,目前也不能解释。

对神经网络的可视化,做出了一些工作,对神经网络的学习内容有了一些直观的了解。但是目前人们仍然不知道神经网络到底在学些什么,可解释性差

最新文章

- Python笔记——类定义

- python流程控制语句 ifelse - 2

- css垂直水平居中方案

- Swift编程语言学习2.1——基础运营商(在)

- android Fragment 用法小结

- 【原创】那些年用过的Redis集群架构(含面试解析)

- [转载] .NET 中可以有类似 JVM 的幻像引用吗?

- SQLServer之创建分区视图

- Win下端口占用问题:OSError: [WinError 10013] 以一种访问权限不允许的方式做了一个访问套接字的尝试

- JS对象的拷贝

- c# 接口的协变和逆变

- [ English ] Ping sb.

- 前端笔记 (1.HTML)

- swift视图的添加及层次变动和基本动画

- unity3d-Visual Studio Tools for Unity快捷键

- CentOS–root密码忘记的解决办法

- 动态规划_01背包问题_Java实现

- rsync+inotify实现实时同步,自动触发同步文件

- 如何修改或美化linux终端

- 操作系统开发之——一个简单的Bootsect