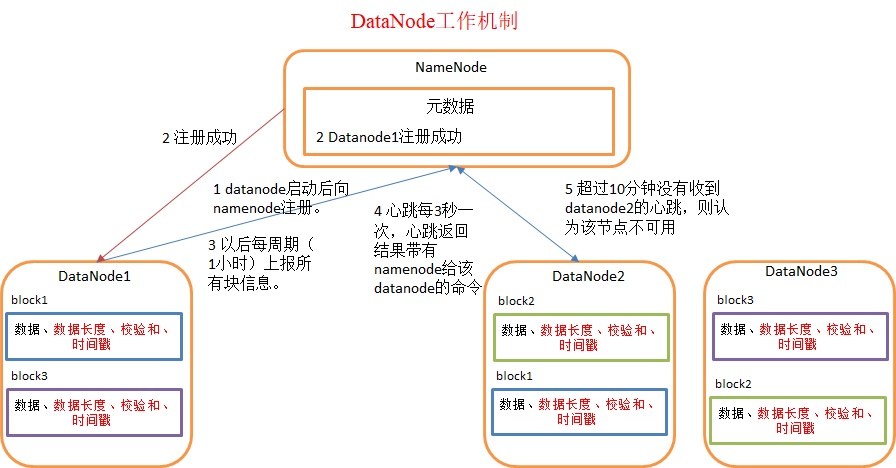

HDFS中DataNode工作机制

1.DataNode工作机制

1)一个数据块在datanode上以文件形式存储在磁盘上,包括两个文件,一个是数据本身,一个是元数据(包括数据块的长度,块数据的校验和,以及时间戳)。

2)DataNode启动后向namenode注册,通过后,周期性(1小时)的向namenode上报所有的块信息。

3)心跳是每3秒一次,心跳返回结果带有namenode给该datanode的命令如复制块数据到另一台机器,或删除某个数据块。如果超过10分钟没有收到某个datanode的心跳,则认为该节点不可用。

4)集群运行中可以安全加入和退出一些机器。

2.数据完整性

1)当DataNode读取block的时候,它会计算checksum

2)如果计算后的checksum,与block创建时值不一样,说明block已经损坏。

3)client读取其他DataNode上的block.

4)datanode在其文件创建后周期验证checksum

3.DataNode掉线时限参数设置

datanode进程死亡或者网络故障造成datanode无法与namenode通信,namenode不会立即把该节点判定为死亡,要经过一段时间,这段时间暂称作超时时长。HDFS默认的超时时长为10分钟+30秒。如果定义超时时间为timeout,则超时时长的计算公式为:

timeout = 2 * dfs.namenode.heartbeat.recheck-interval + 10 * dfs.heartbeat.interval

而默认的dfs.namenode.heartbeat.recheck-interval 大小为5分钟,dfs.heartbeat.interval默认为3秒。

需要注意的是hdfs-site.xml 配置文件中的heartbeat.recheck.interval的单位为毫秒,dfs.heartbeat.interval的单位为秒。

<property>

<name>dfs.namenode.heartbeat.recheck-interval</name>

<value>300000</value>

</property>

<property>

<name> dfs.heartbeat.interval </name>

<value>3</value>

</property>

1

)当DataNode读取block的时候,它会计算checksum

2)如果计算后的checksum,与block创建时值不一样,说明block已经损坏。

3)client读取其他DataNode上的block.

4)datanode在其文件创建后周期验证checksum

最新文章

- AC日记——C’s problem(c) TYVJ P4746 (清北学堂2017冬令营入学测试第三题)

- chrome调试hove等类似事件

- Socket实现仿QQ聊天(可部署于广域网)附源码(1)-简介

- SharePoint 2013 WebPart 管理工具分享[开源]

- always NetWork Performance measure Tools

- 关于css中伪类及伪元素的总结

- OpenSceneGraph FAQ

- Play 起步

- sed中引用变量

- WEB API系列(一):WEB API的适用场景、第一个实例

- 纯css3单选框/复选框美化样式代码

- 十二、u-boot 调试--串口修改

- java高级 - java利用listener实现回调,即观察者模式

- MySQL事务笔记

- 007 关于Spark下的第二种模式——standalone搭建

- Es6 的类(class)

- TJU Problem 2101 Bullseye

- jQuery封装和优化

- jQuery学习笔记(jquery.simplemodal插件)

- 开始转型学习java