论文笔记(2)-Dropout-Regularization of Neural Networks using DropConnect

2024-08-23 21:02:49

这篇paper使用DropConnect来规则化神经网络。dropconnect和dropout的区别如下图所示。dropout是随机吧隐含层的输出清空,而dropconnect是input unit到hidden unit输入权值以1-p的概率清0

dropout的关键公式,其中m是size为d的列向量格式如下[0 0 1 0 0 0 1 1 ]T .这样的话就把隐层到输出层以一定的概率清空,概率一般为0.5

dropconnect的关键公式,其中M和上面的m一个含义。这个就是说从输入层到隐层就要有一定的概率来清空。

dropconnect的算法流程如下,和普通的算法不同的地方就是随机sample一个M mask,活动函数里面需要乘这个M

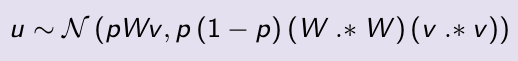

inference的过程如下图,对DropConnect进行推理时,采用的是对每个输入(每个隐含层节点连接有多个输入)的权重进行高斯分布的采样。该高斯分布的均值与方差当然与前面的概率值p有关,满足的高斯分布为:

最新文章

- webapi的学习资料

- 个人纪录(初)----配置文件.properties的简单读取

- php源码安全加密之PHP混淆算法.

- smarty模板原理

- acdream.LCM Challenge(数学推导)

- 七大查找算法(附C语言代码实现)

- 论文笔记之:Fully Convolutional Attention Localization Networks: Efficient Attention Localization for Fine-Grained Recognition

- 华为OJ平台——超长正整数相加

- EditText无法失去焦点、失去焦点隐藏软键盘

- SpringBoot报错:Invalid bound statement (not found)

- 【GO】【环境配置】

- 开源在线分析诊断工具Arthas(阿尔萨斯)--总结

- CF487E Tourists 圆方树、树链剖分

- Spring事务银行转账示例

- [zoj4045][思维+dfs]

- 一段JS控制TD中图片的大小的代码

- linux cp 命令详解

- Linux系统——MySQL基础(三)

- 201709020工作日记--synchronized、ReentrantLock、读写锁

- Linux学习笔记:输入输出重定向 >>命令