tf.nn.softmax_cross_entropy_with_logits()函数的使用方法

2024-09-01 05:53:55

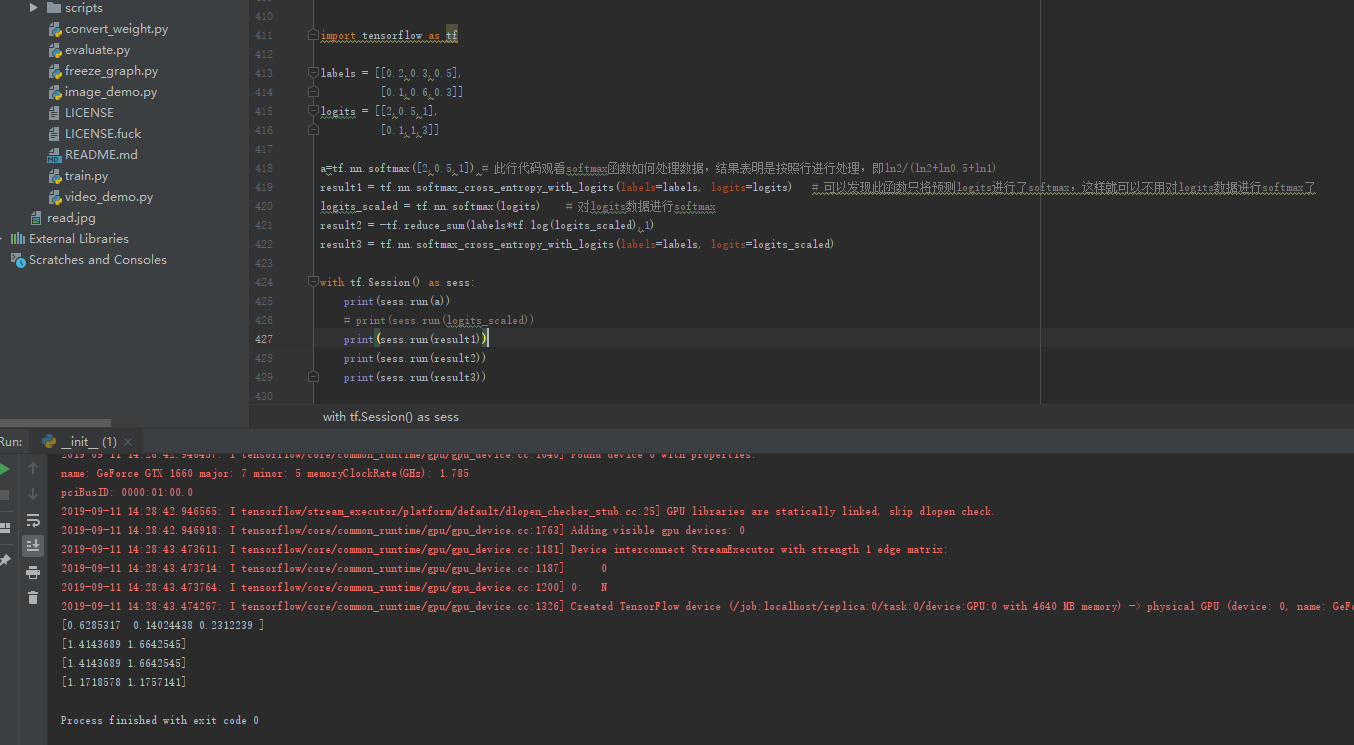

import tensorflow as tf labels = [[0.2,0.3,0.5],

[0.1,0.6,0.3]]

logits = [[2,0.5,1],

[0.1,1,3]] a=tf.nn.softmax([2,0.5,1]) # 此行代码观看softmax函数如何处理数据,结果表明是按照行进行处理,即ln2/(ln2+ln0.5+ln1)

result1 = tf.nn.softmax_cross_entropy_with_logits(labels=labels, logits=logits) # 可以发现此函数只将预测logits进行了softmax,这样就可以不用对logits数据进行softmax了

logits_scaled = tf.nn.softmax(logits) # 对logits数据进行softmax

result2 = -tf.reduce_sum(labels*tf.log(logits_scaled),1)

result3 = tf.nn.softmax_cross_entropy_with_logits(labels=labels, logits=logits_scaled) with tf.Session() as sess:

print(sess.run(a))

# print(sess.run(logits_scaled))

print(sess.run(result1))

print(sess.run(result2))

print(sess.run(result3))

softmax实际就是将输入函数带到一个方程np.power(np.e,xi)/Σnp.power(np.e,xi)中得到,其代码如下:

[2,0.5,1]

a=np.power(np.e,2)+np.power(np.e,0.5)+np.power(np.e,1)

print(np.power(np.e,2)/a)

最新文章

- Notes:SVG(3)---滤镜和渐变

- java6

- fzu1036四塔问题(汉诺塔问题拓展)

- 一个大数据的demo

- 用Phaser实现Flappy Bird 游戏

- PMP 第二章 项目生命周期与组织

- jQuery官方基础教程笔记(转载)

- JavaScript Tips

- [AX2012]Claims user

- java基础练习[一]

- 将struts源码导入eclipse

- SharePoint安全 - 在Goolge和Bing中查找SharePoint相关内容

- PC端模拟手机浏览网页

- Visual studio C#语言输出调试信息到Output窗口方法

- 【转】win7+ubuntu双系统安装方法--不错

- JAVA GUI学习 - JMenuBar菜单条、JMenu菜单、JMenuItem菜单项组件学习

- 初步学习nodejs,业余用node写个一个自动创建目录和文件的小脚本,希望对需要的人有所帮助

- java.lang.StringBuilder和java.lang.StringBuffer (JDK1.8)

- dev gridControl 自定义绘制列头颜色

- Gridview的item含有checkbox,setOnItemClickListener方法失效的问题