Transformer---GPT模型

2024-08-27 01:38:32

一、GPT(Generative Pre-Training)

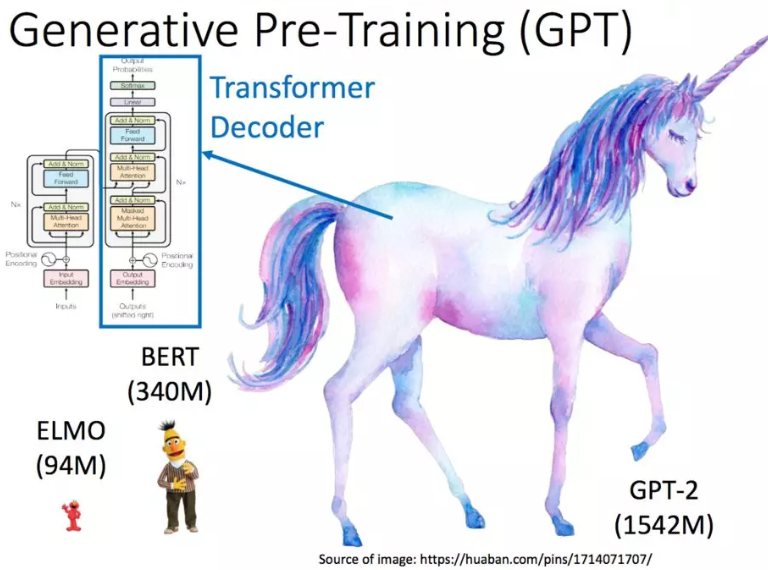

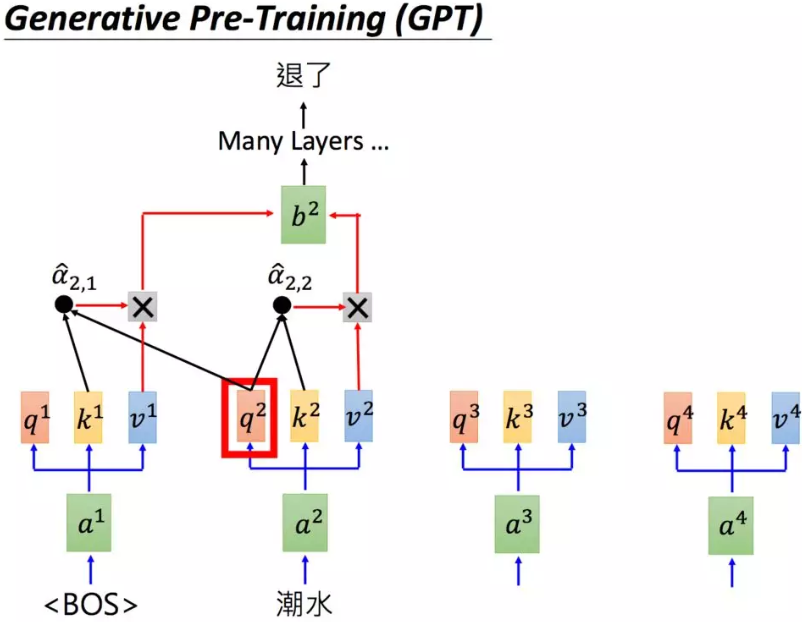

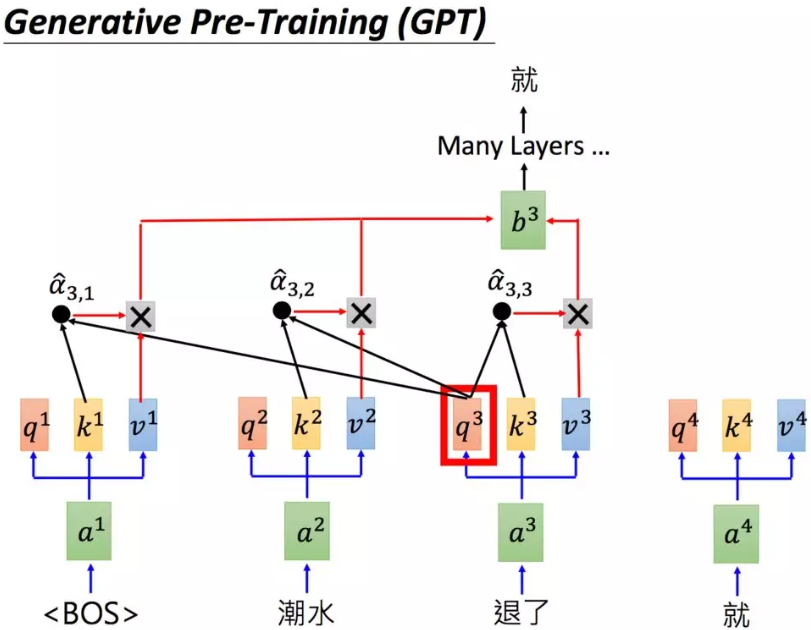

GPT-2的模型非常巨大,它其实是Transformer的Decoder。GPT-2是Transformer的Decoder部分,输入一个句子中的上一个词,我们希望模型可以得到句子中的下一个词。

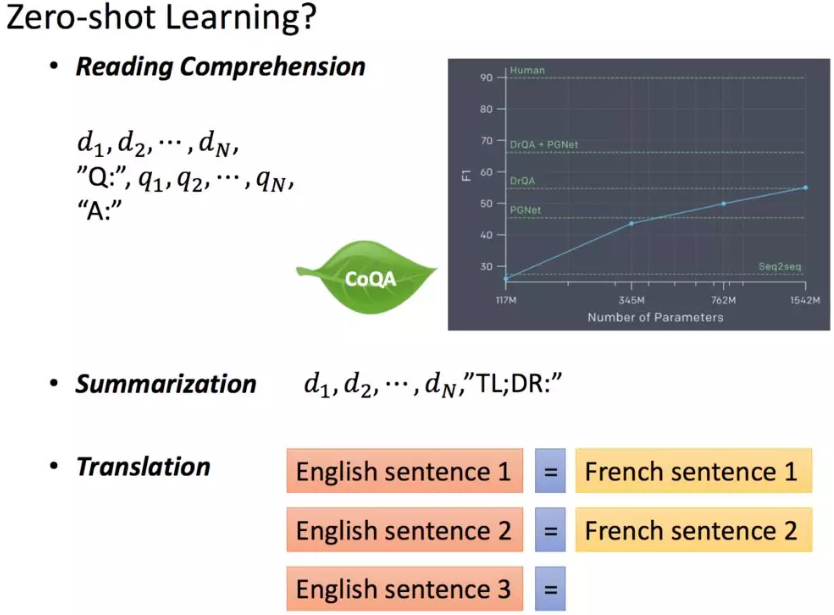

由于GPT-2的模型非常巨大,它在很多任务上都达到了惊人的结果,甚至可以做到zero-shot learning(简单来说就是模型的迁移能力非常好),如阅读理解任务,不需要任何阅读理解的训练集,就可以得到很好的结果。

GPT-2可以自己进行写作

0-5层与0-5head的对应:

参考文献:

【1】李宏毅机器学习2019(国语)_哔哩哔哩 (゜-゜)つロ 干杯~-bilibili

最新文章

- c#_1:后台post请求

- linux 安装一些命令

- 《深入浅出Node.js》第8章 构建Web应用

- 我对java反射机制的理解

- HDU 5680 zxa and set (数学 推导结论)

- [mock]12月11日

- yaxim

- ESRI Shapefiles (SHP)

- Controller 和 Action (2)

- pho

- Java匿名内部类访问外部

- 【PHP】最详细PHP从入门到精通(一)——想学习PHP的朋友们福利来了!

- debounce(防抖动函数)

- visual c++中预定义的宏

- c#中如何退出程序后自动重新启动程序

- CDH离线安装

- jQuery控制checkbox选中状态但是不显示选中

- (转)Hive自定义UDAF详解

- bzoj1014: [JSOI2008]火星人prefix(splay+hash+二分)

- Linq-语句之Select/Distinct和Count/Sum/Min/Max/Avg