【Tool】Linux下的Spark安装及使用

2024-08-29 03:50:58

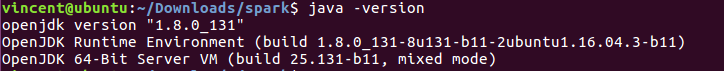

1. 确保自己的电脑安装了JAVA Development Kit JDK, 用来编译Java应用, 如 Apache Ant, Apache Maven, Eclipse. 这里是我们安装Spark的支持环境.

查看自己是否安装了JDK: java -version

这里我已经安装了所以显示的是JDK的版本信息, 如果没有安装则显示"The program java can be found in the following packages"

2. 安装好Java环境之后可以在Spark官网上下载自己要的Spark版本: http://spark.apache.org/downloads.html

下载之后解压缩: tar -xf spark-***-bin-hadoop**.tgz(对应着你下载的版本号)

3. 更新profile文件: sudo vi ~/etc/profile 在后面加入:

SPARK_HOME=/home/vincent/Downloads/spark

#(解压后的包所在的路径, 这里我将解压后的Spark重新命名为spark了)

PATH=$PATH:${SPARK_HOME}/bin

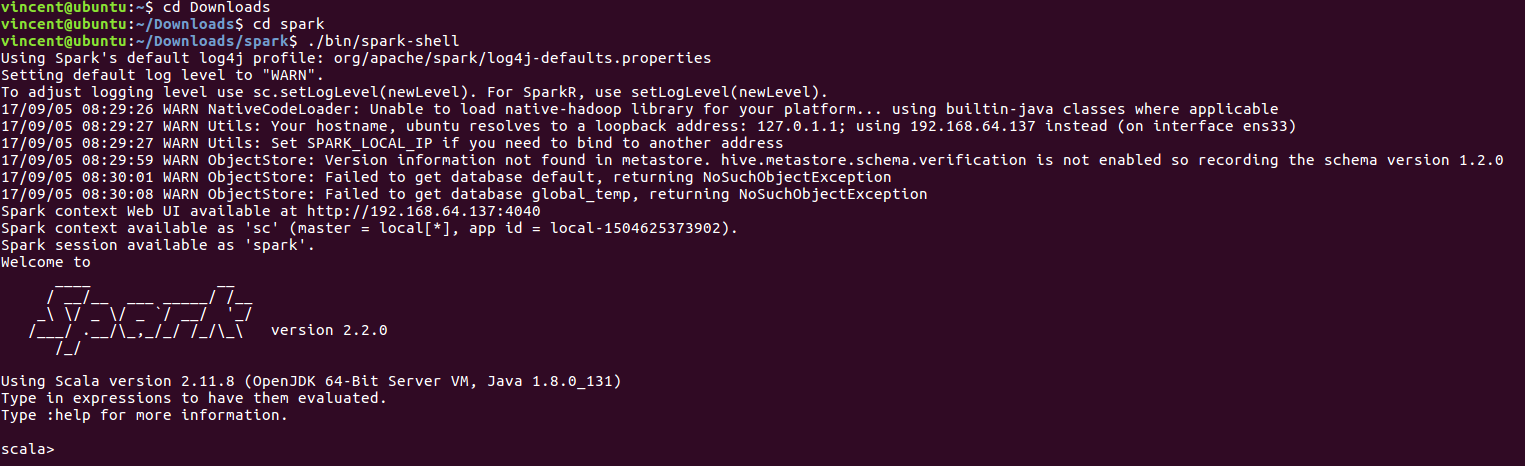

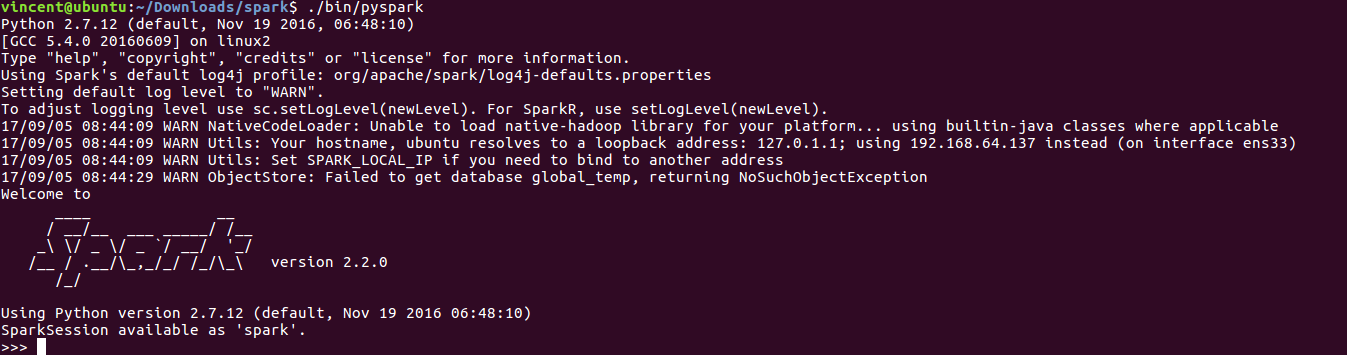

4. 进入spark安装位置, 然后进入spark中的 bin 文件夹

运行: ./bin/spark-shell 运行scala

运行: ./bin/pyspark (python)

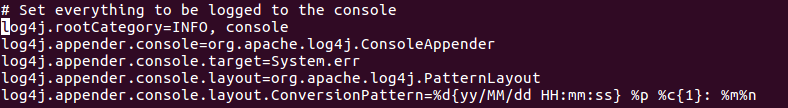

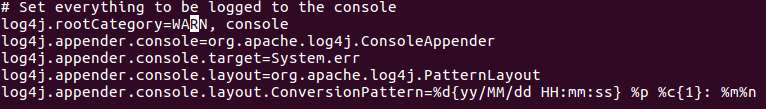

5. 调整日志级别控制输出的信息量:

在conf目录下将log4j.properties.template 复制为 log4j.properties, 然后找到 log4j.rootCategory = INFO, console

将INFO改为WARN (也可以设置为其他级别)

之后再打开shell输入信息量会减少.

最新文章

- Code Review 程序员的寄望与哀伤

- C/C++ 结构体 指针 函数传递

- Json格式转换

- socket-自我总结(1)

- UIScrollView滚动视图

- [Python] Basic operations in Pycharm

- Everyday is an Opportunity

- poj2411Mondriaan's Dream(状压)

- codeforces 505C Mr. Kitayuta, the Treasure Hunter(dp)

- 第三部分 关于HHibernate中关键字ID的配置

- C#DataTable操作

- Swift—Core Foundation框架-备

- BNU10791:DOTA选人

- 以前的loginUI

- C++ 头文件系列(map)

- wcf类库及宿主

- K-means聚类 的 Python 实现

- 小程序+node+mysql做的小项目

- 小tips:node起一个简单服务,打开本地项目或文件浏览

- 4572: [Scoi2016]围棋 轮廓线DP KMP

热门文章

- 迁移IPv6:6To4隧道技术

- html css 样式中100%width 仍有白边解决办法

- HDU 2300 Crashing Robots

- laravel :Call to undefined function App\Http\Controllers\success() 解决方法

- [USACO07OPEN]Catch That Cow

- 代理上网环境配置docker私有库

- synchronized的实现原理及锁优化

- 第十一章 Servlet MVC模式

- Error: Password file read access must be restricted: /etc/cassandra/jmxremote.password

- android 读取xml