TF Notes (5), GRU in Tensorflow

2024-09-06 13:00:12

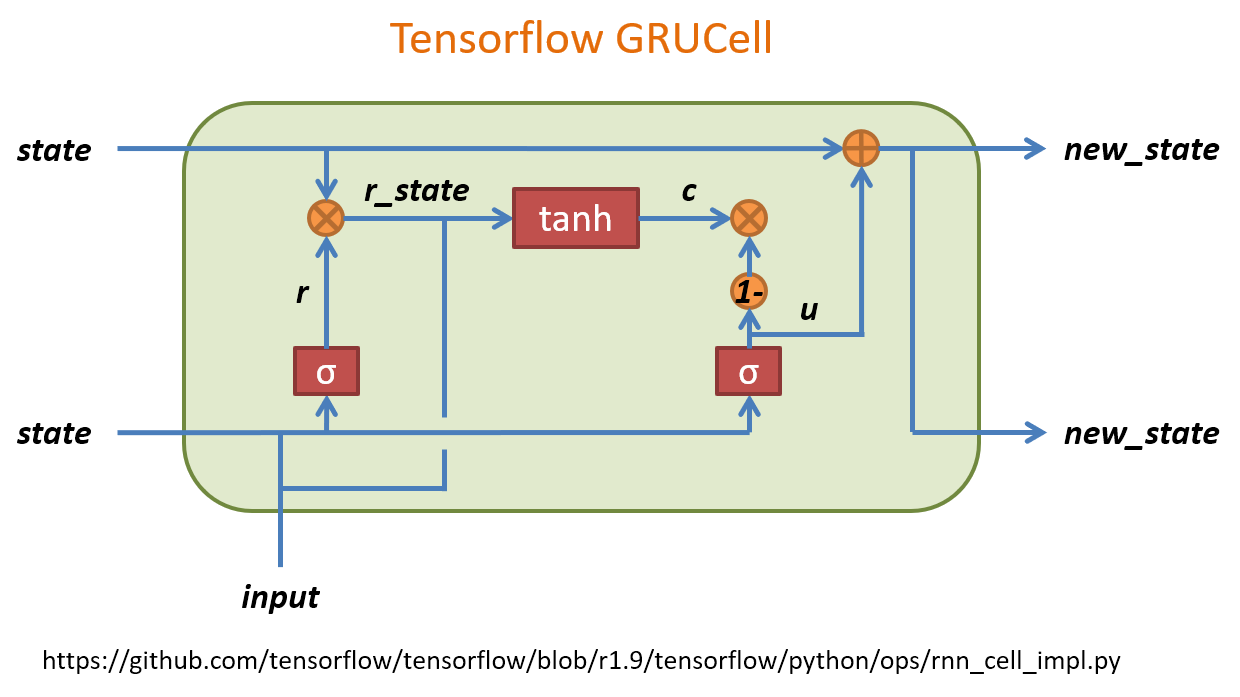

小筆記. Tensorflow 裡實作的 GRU 跟 Colah’s blog 描述的 GRU 有些不太一樣. 所以做了一下 TF 的 GRU 結構. 圖比較醜, 我盡力了… XD

TF 的 GRU 結構

u 可以想成是原來 LSTM 的 forget gate, 而 c 表示要在 memory cell 中需要記住的內容. 這個要記住的內容簡單講是用一個 gate (r) 來控制之前的 state 有多少比例保留, concate input 後做 activation transform 後得到. 可以對照下面 tf source codes.

TF Source Codes

|

|

最新文章

- C语言之预处理

- 勇者斗恶龙UVa11292 - Dragon of Loowater

- BZOJ4417: [Shoi2013]超级跳马

- ado执行sql查询出现“发送数据流时出现算术溢出”错误

- GitHub 开源工具整理

- 关于Shell中命令替换$(...)与后置引用`...`的不同

- 25.allegro中模块复用[原创]

- Android多媒体-人脸识别

- HDU5029--Relief grain (树链剖分+线段树 )

- Git协作

- android堆栈调试--详细

- Angular 学习笔记 ( CDK - Overlays )

- 关于一些基础的Java问题的解答(五)

- Median

- python并发编程之多线程1

- final可以修饰类、属性、方法。

- linux下如何执行.sh文件 【转】

- web service 部 分

- HTML学习-2标记标签-2

- 「PKUWC2019」拓扑序计数(状压dp)

热门文章

- SaltStack事件驱动 – event reactor

- C# 查找其他应用程序并打开、显示、隐藏、关闭的API

- ios 获取app版本号

- Opencv笔记(十七)——轮廓性质

- C++ for循环遍历几种写法

- 关于Tarjan的一些问题

- 手机APP例如抖音,让 people‘s 注意力集中到了 社会进化的 优胜部分 (优胜劣汰,什么是优) + 真善美,的 “美” , 促进了2极分化, 会产生强者俞强,弱者越弱,确实促进了信息的流通,传播了有用的东东 产生了独特的价值 而 如何 能计算出这些价值呢, 需要 数学 金融 财务 货币 量化吗

- DRF认证、自定义认证和权限、自定义权限

- 十四、linux-MySQL的数据库集群读写分离及高可用性、备份等

- dubbo同步/异步调用的方式