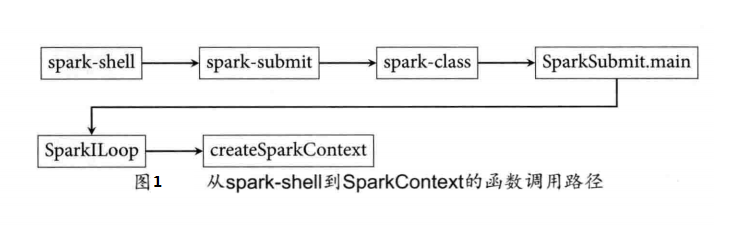

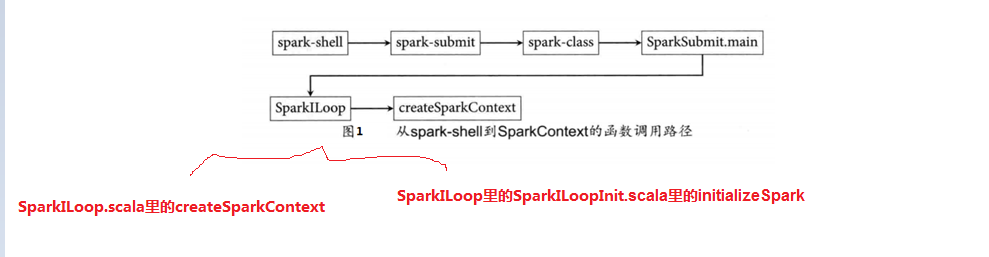

从Spark-Shell到SparkContext的函数调用路径过程分析(源码)

2024-08-29 16:42:11

不急,循序渐进,先打好基础

Spark shell的原理

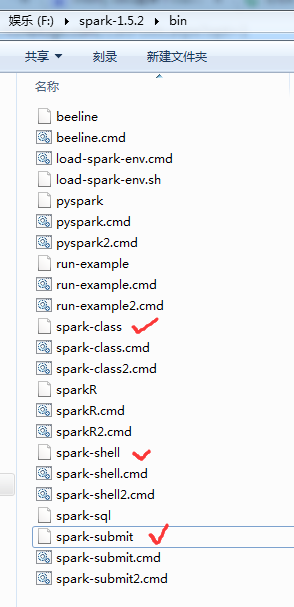

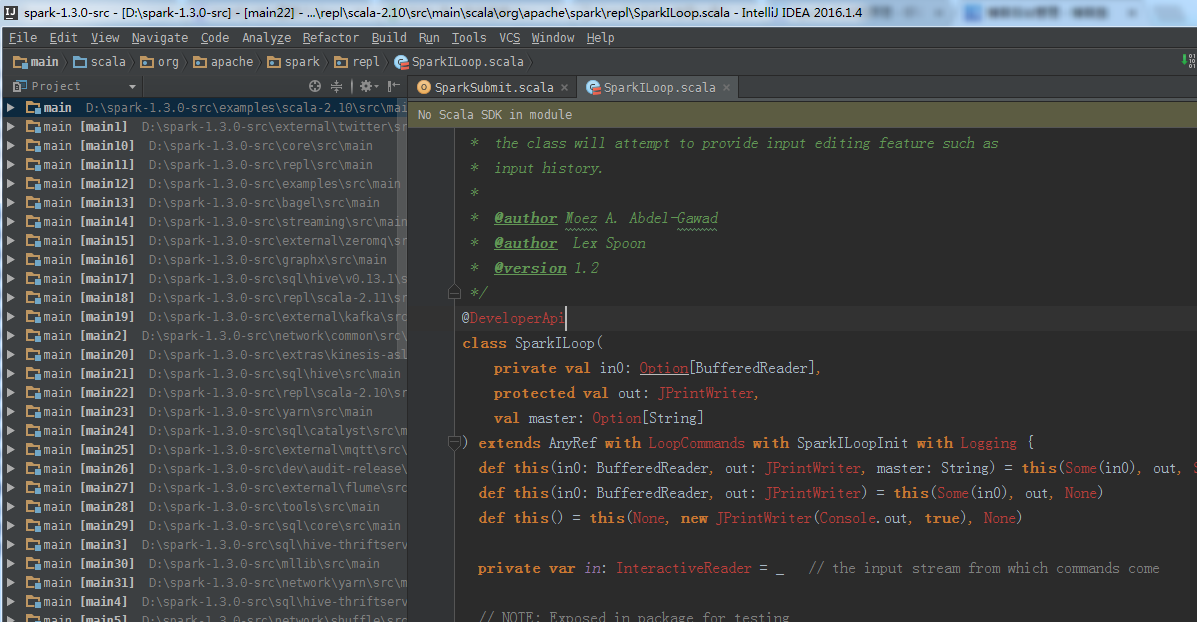

首先,我们清晰定位找到这几个。

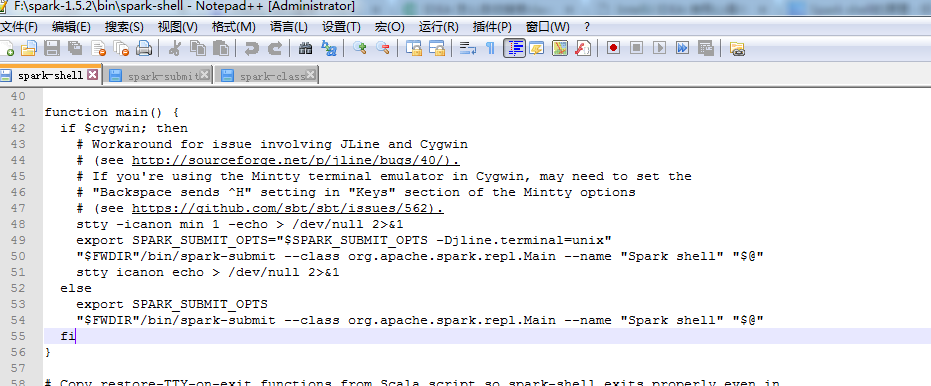

1、spark-shell

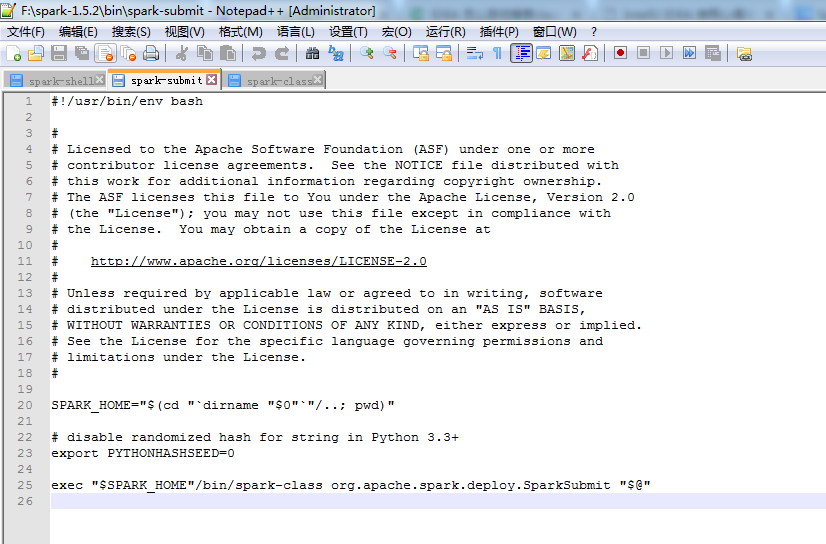

2、 spark-submit

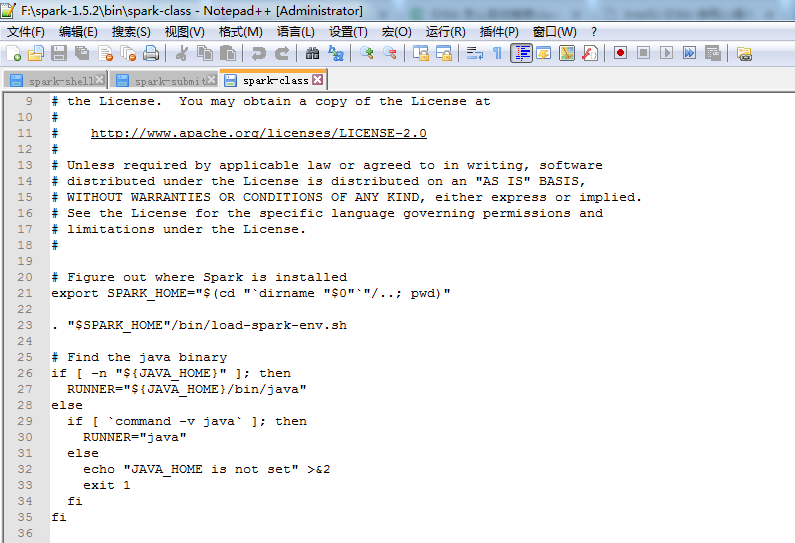

3、spark-class

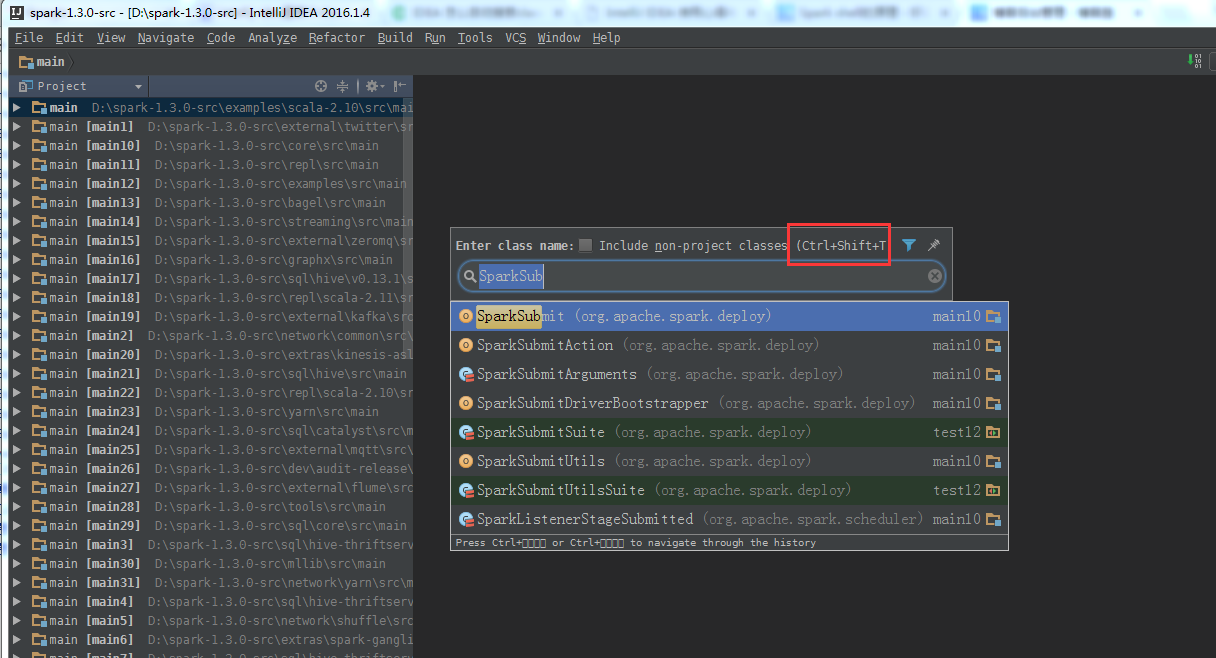

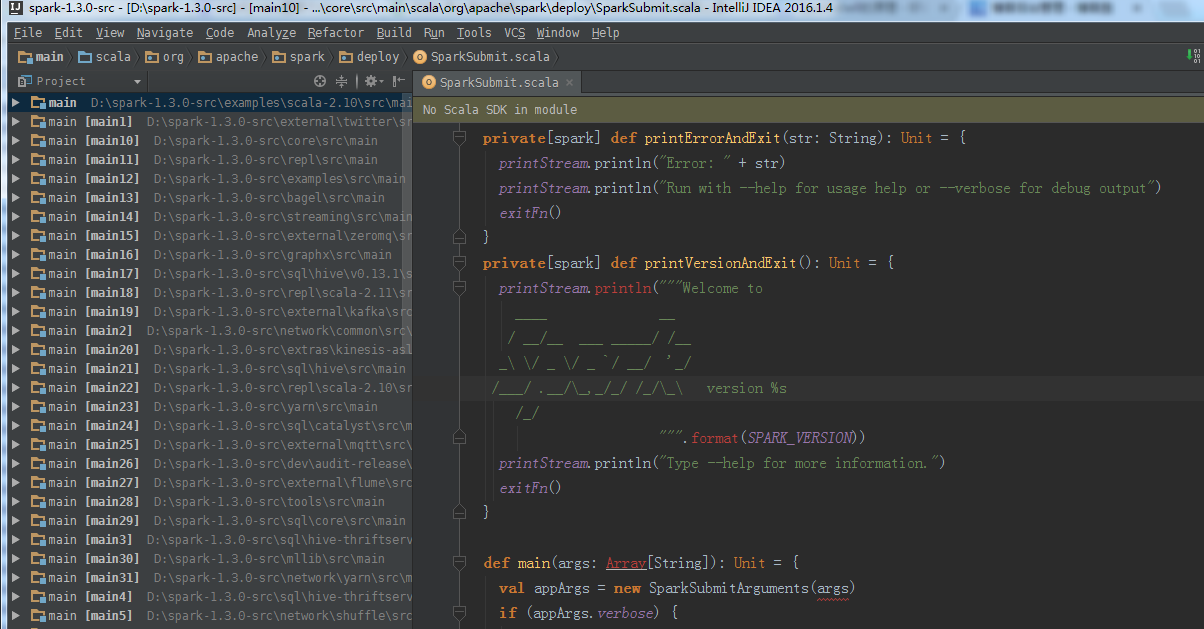

4、SparkSubmit.scala

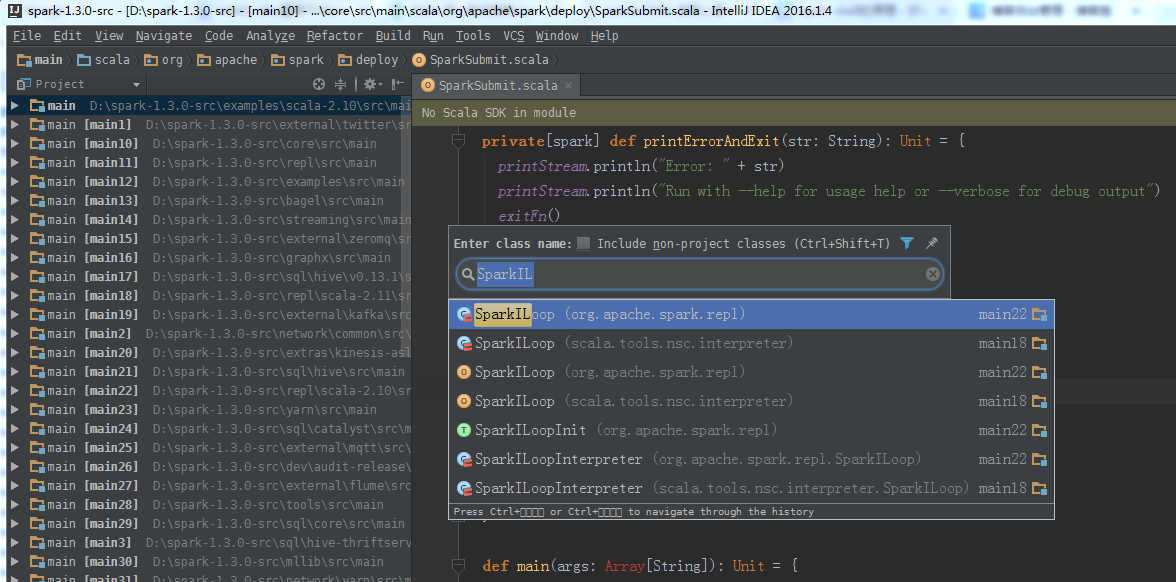

5、SparkILoop.scala

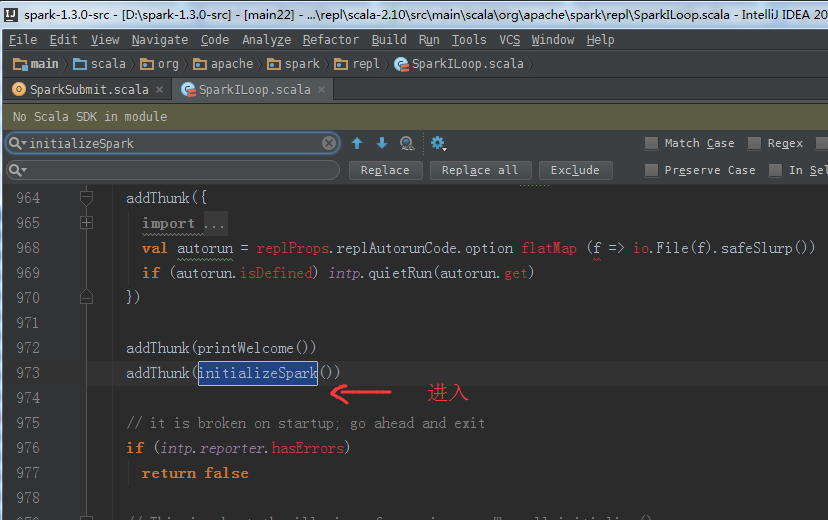

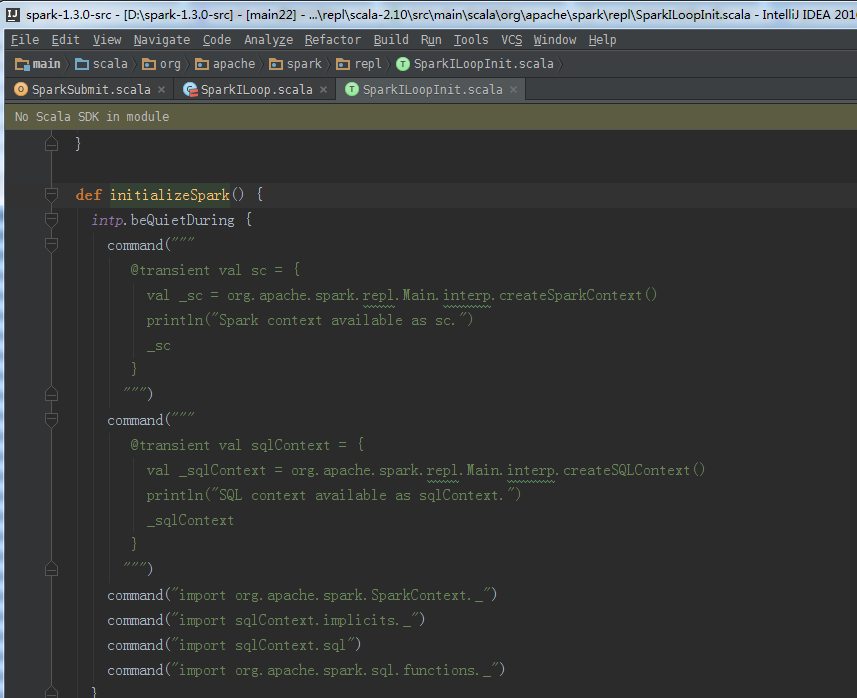

initializeSpark的源码

def initializeSpark() {

intp.beQuietDuring {

command("""

@transient val sc = {

val _sc = org.apache.spark.repl.Main.interp.createSparkContext()

println("Spark context available as sc.")

_sc

}

""")

command("""

@transient val sqlContext = {

val _sqlContext = org.apache.spark.repl.Main.interp.createSQLContext()

println("SQL context available as sqlContext.")

_sqlContext

}

""")

command("import org.apache.spark.SparkContext._")

command("import sqlContext.implicits._")

command("import sqlContext.sql")

command("import org.apache.spark.sql.functions._")

}

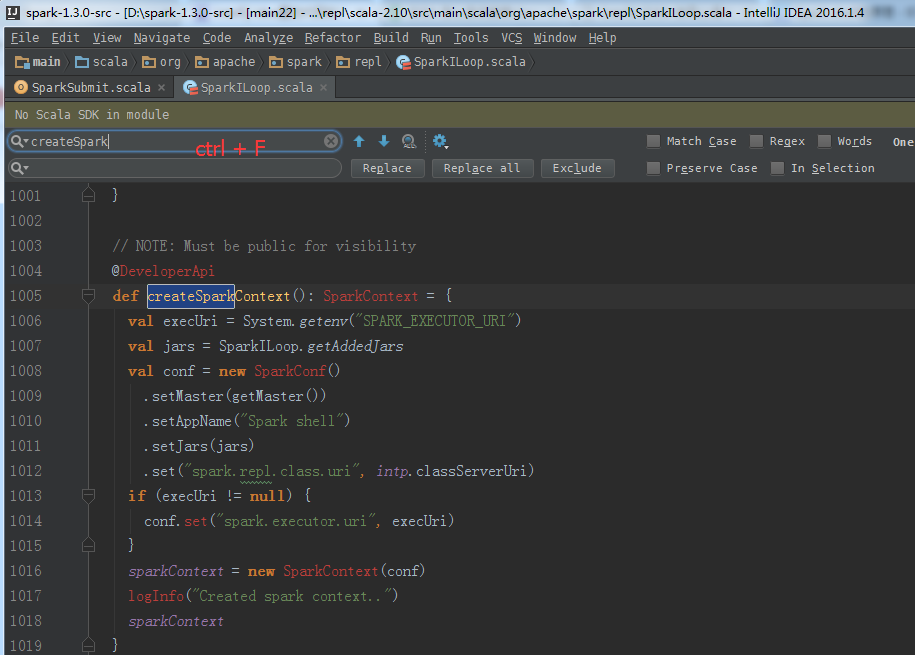

createSparkContext的源码

// NOTE: Must be public for visibility

@DeveloperApi

def createSparkContext(): SparkContext = {

val execUri = System.getenv("SPARK_EXECUTOR_URI")

val jars = SparkILoop.getAddedJars

val conf = new SparkConf()

.setMaster(getMaster())

.setAppName("Spark shell")

.setJars(jars)

.set("spark.repl.class.uri", intp.classServerUri)

if (execUri != null) {

conf.set("spark.executor.uri", execUri)

}

sparkContext = new SparkContext(conf)

logInfo("Created spark context..")

sparkContext

}

总结

最新文章

- 【原】浅谈KL散度(相对熵)在用户画像中的应用

- no sigar-amd64-winnt.dll in java.library.path 错误

- oracle中查询某张表都被哪些表参照了

- asp.net mvc Html.BeginForm()方法

- java实现八皇后问题(递归和循环两种方式)

- C#_StringBuilder分离字符串实例

- 批处理 Mysql Findstr

- 【UVA 1151】 Buy or Build (有某些特别的东东的最小生成树)

- maven配置默认jdk版本

- [github] 创建个人网页

- linux内网机器访问外网代理设置squid

- C# datetimePicker控件格式设置

- FileMethods

- python爬虫(1)——urllib包

- MySQL安装后无法用root用户访问的问题

- redis离线集群安装

- Win10问题汇总

- 腾讯云服务器CentOS 7防火墙firewalld管理

- REST API TO MiniProgram 上线WordPress官方插件库

- ng环境搭建步骤