利用Pycharm本地调试spark-streaming(包含kafka和zookeeper等操作)

2024-10-12 03:04:23

环境准备就不说了!

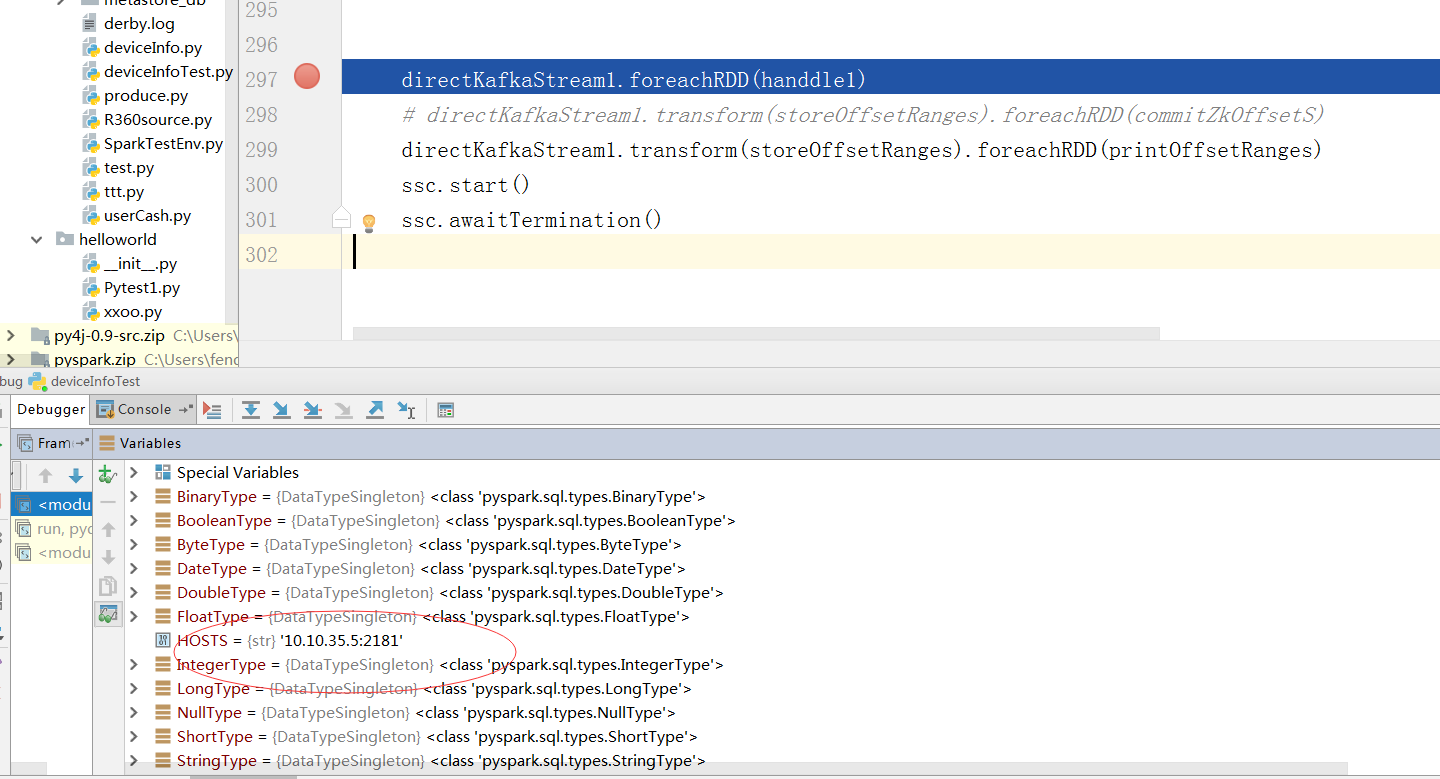

第一步:打开Pycharm,在File->Setting->Project Structure中点击Add Content Root 添加本地python调用java和spark的组件(因为python和spark通讯是通过调用Jvm的相关组件实现的) ,包含两个压缩包可以在spark的安装包里面找到

第二步:在项目文件内添加本地配置

os.environ['SPARK_HOME'] = r'C:\Users\fengxu\Desktop\bigdata-software\spark-1.6.0-bin-hadoop2.6'

os.environ['JAVA_HOME'] = r'C:\software\jdk1.8'

sys.path.append(r"C:\Users\fengxu\Desktop\bigdata-software\spark-1.6.0-bin-hadoop2.6\python") 第三步:也是最重要的一步需要在本地的spark安装包内找到spark-defaults.conf的配置文件在末尾添加一行

spark.jars.packages org.apache.spark:spark-streaming-kafka-0-8_2.10:2.0.1

这是本地操作kafka和一些组件的必备jar包。配置完毕以后就可以在maven仓库下载相关jar包了

(报了很多错误,查阅了很多英文文档才找到答案,国内没有找到相关问题答案) 成功后就可以利用本地的python和本地相关组件(spark,kafka hdfs)调试和操作远程组件了!

成功后会在本地环境生成(多线程模拟集群)写入的hdfs文件可以调试了,操作本地文件还是很有用的哈!

最新文章

- CSS 学习质料

- Delphi GDI或图像处理的博客

- 通过项目逐步深入了解Mybatis<三>

- 开源 & 免费使用 & 打包下载自行部署 :升讯威 周报系统

- OpenCv函数学习(一)

- [WC 2013]糖果公园

- c/c++ 网络编程 read,write函数深入理解

- Linux三个网络监视器之《二》——nethogs

- SpringBoot多模块项目打包问题

- CentOS yum 安装 Apache + PHP + MySQL

- java 中 ResourceBundle 使用 国际化使用

- C#.NET接收JSON数组

- CCF-20170903-JSON查询

- JS的浅拷贝与深拷贝

- MySQL PID错误,Mysql server PID file could not be found!

- node-sass 解决 no such file or directory

- 快速沃尔什变换 FWT 学习笔记【多项式】

- ng开启缓存 造成的问题:

- (转)winform安装项目、安装包的制作、部署

- JAVA基础学习之路(二)方法定义,重载,递归