scrapy爬取迅雷电影天堂最新电影ed2k

2024-09-02 00:53:42

前言

几天没用scrapy爬网站了,正好最近在刷电影,就想着把自己常用的一个电影分享网站给爬取下来保存到本地mongodb中

项目开始

第一步仍然是创建scrapy项目与spider文件

切换到工作目录两条命令依次输入

- scrapy startproject xunleidianying

- scrapy genspider xunleiBT https://www.xl720.com/thunder/years/2019

内容分析

打开目标网站(分类是2019年上映的电影),分析我们需要的数据

进入页面是列表的形式就像豆瓣电影一样,然后我们点进去具体页面看看

这个页面就是我们需要拿到的内容页面,我们来看我们需要哪些数据(某些数据从第一个页面就可以获得,但是下载地址必须到第二个页面)

- 电影名称

- 电影信息

- 电影内容剧情

- 电影下载地址

分析完成之后就可以首先编写 items.py文件

import scrapy class XunleidianyingItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

name = scrapy.Field()

information = scrapy.Field()

content = scrapy.Field()

downloadurl = scrapy.Field()

pass

另外别忘了去settings.py中开启 ITEM_PIPELINES 选项

爬虫文件编写

老样子,为了方便测试我们的爬虫,首先编写一个main.py的文件方便IDE调用

main.py:

import scrapy.cmdline

scrapy.cmdline.execute('scrapy crawl xunleiBT'.split())

首先我们先测试直接向目标发送请求是否可以得到响应

爬虫文件 xunleiBT.py编写如下:

# -*- coding: utf-8 -*-

import scrapy class XunleibtSpider(scrapy.Spider):

name = 'xunleiBT'

allowed_domains = ['https://www.xl720.com/thunder/years/2019']

start_urls = ['https://www.xl720.com/thunder/years/2019/'] def parse(self, response):

print(response.text)

pass

运行 main.py 看看会出现什么

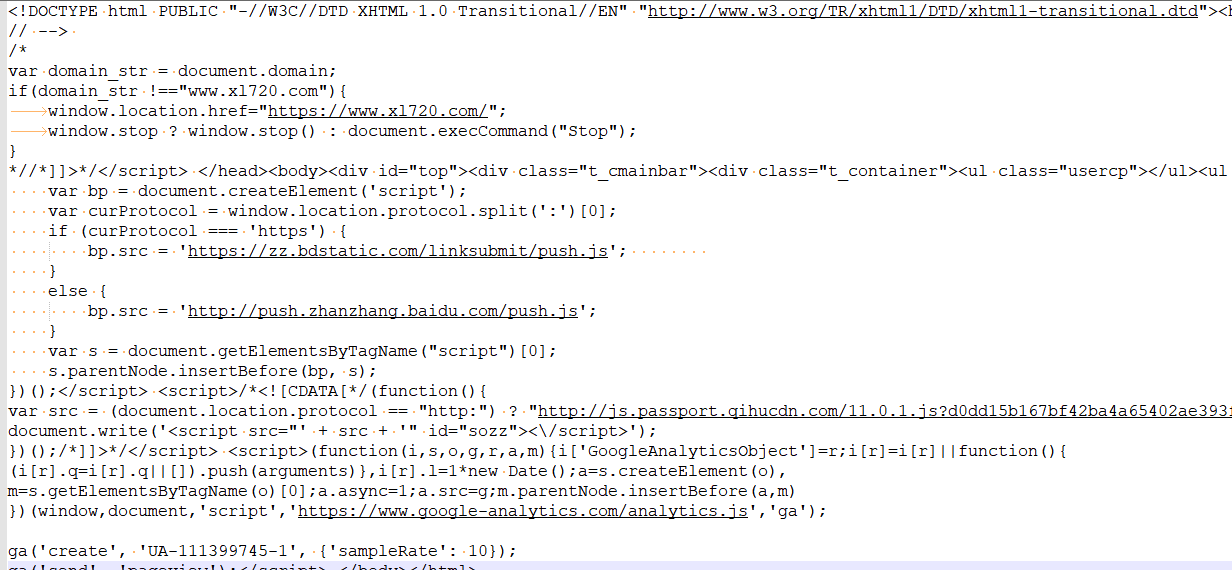

好的,发现直接返回正常的网页也就是我们要的网页,说明该网站没有反爬机制,这样我们就更容易爬取了

然后通过xpath定位页面元素,具体就不再赘述,之前的scarpy教程中都有 继续编写爬虫文件

# -*- coding: utf-8 -*-

import scrapy

#导入编写的 item

from xunleidianying.items import XunleidianyingItem class XunleibtSpider(scrapy.Spider):

name = 'xunleiBT'

allowed_domains = ['www.xl720.com']

start_urls = ['https://www.xl720.com/thunder/years/2019/'] def parse(self, response):

url_list = response.xpath('//h3//@href').getall()

for url in url_list:

yield scrapy.Request(url,callback=self.detail_page)

nextpage_link = response.xpath('//a[@class="nextpostslink"]/@href').get()

if nextpage_link:

yield scrapy.Request(nextpage_link, callback=self.parse) def detail_page(self,response):

# 切记item带括号

BT_item = XunleidianyingItem()

BT_item['name'] = response.xpath('//h1/text()').get()

BT_item['information'] = ''.join(response.xpath('//div[@id="info"]//text()').getall())

BT_item['content'] = response.xpath('//div[@id="link-report"]/text()').get()

BT_item['downloadurl'] = response.xpath('//div[@class="download-link"]/a/text() | //div[@class="download-link"]/a/@href').getall()

yield BT_item

ITEM爬取完成后该干什么?当然是入库保存了,编写pipelines.py文件进行入库保存

再次提醒别忘了去settings.py中开启 ITEM_PIPELINES 选项

pipelines.py文件代码如下:

import pymongo

#连接本地数据库

myclient = pymongo.MongoClient("mongodb://localhost:27017/")

#数据库名称

mydb = myclient["movie_BT"]

#数据表名称

mysheet = mydb["movie"] class XunleidianyingPipeline(object):

def process_item(self, item, spider):

data = dict(item)

mysheet.insert(data)

return item

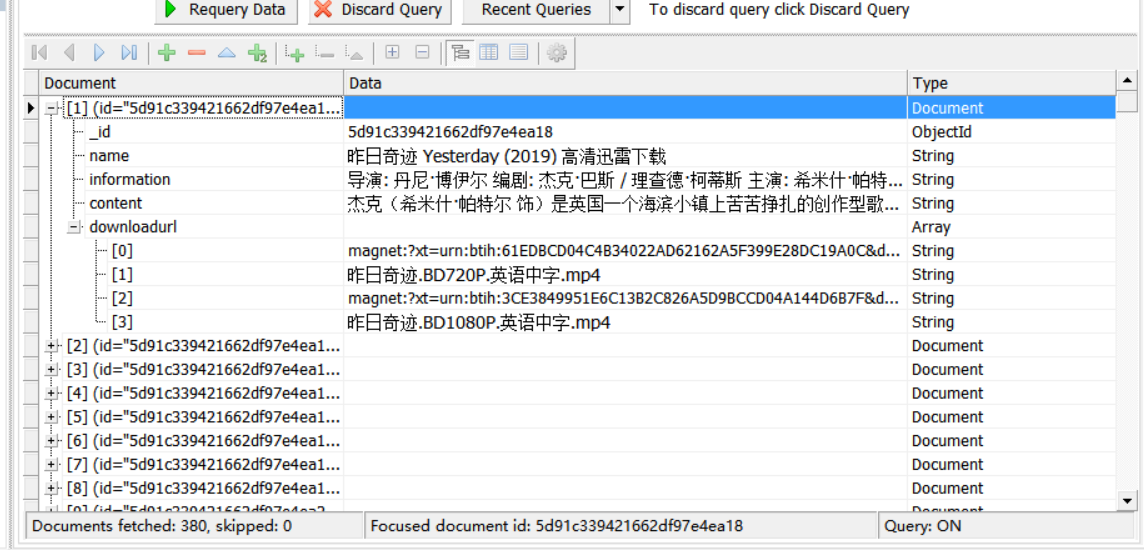

再次运行main.py 等待运行完成后打开数据库查询

数据保存完成,这次我们一共导入了380个数据,可以愉快的查看电影了

最新文章

- springmvc请求接收参数的几种方法

- 我的vim配置文件.vimrc

- java操作MySQL数据事务的简单学习

- 使用 Linux 终端 SSH 登录 VPS

- java邮件发送 qq与163邮箱互发和qq和163邮箱发送其他邮箱实例

- 第26讲 对话框AlertDialog的自定义实现

- 改变UITableViewCell按下去的颜色

- Visual C++学习笔记1:一定要注意ANSI和UNICODE差额

- JS同源策略和跨域问题

- Java编程的逻辑 (51) - 剖析EnumSet

- WPF DataGrid分页功能实现代码

- mybatis进行一对多时发现的问题总结

- CSS属性disabled和readonly的区别是什么

- English trip -- VC(情景课)9 B Outside chores 室外家务

- scala下实现actor多线程基础

- word2vec 细节解析1

- WinCE数据通讯之Web Service篇

- 一款不错的jQuery分页插件--pagination

- [CoffeeScript]使用Yield功能

- hive的rownumber()的使用

热门文章

- zookeeper快速上手

- Leetcode之回溯法专题-78. 子集(Subsets)

- python3 使用urllib报错urlopen error EOF occurred in violation of protocol (_ssl.c:841)

- spring-cloud-kubernetes与SpringCloud Gateway

- 2019 Multi-University Training Contest 2

- cogs 1199选课(树形dp 背包或多叉转二叉

- 线段树离散化 unique + 二分查找 模板 (转载)

- 天梯杯 L2-023 图着色问题

- 基于单细胞测序数据构建细胞状态转换轨迹(cell trajectory)方法总结

- 【Nginx】(主从热备)LVS+Keepalived+Nginx实现高性能负载均衡集群