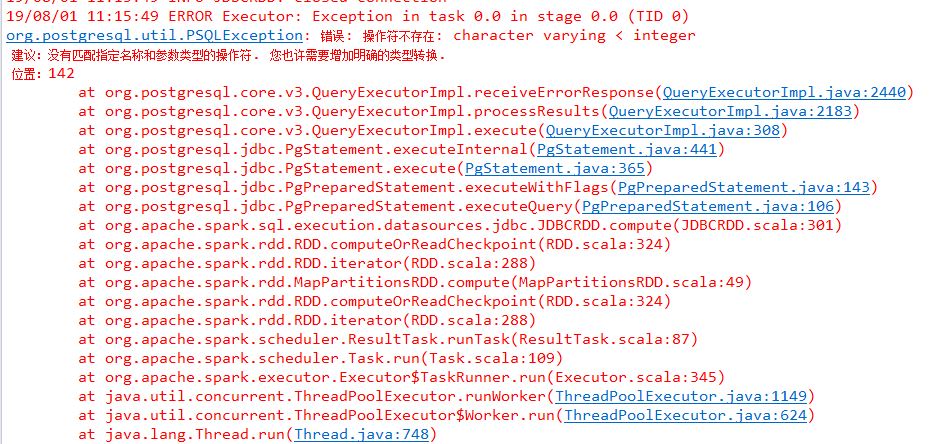

spark读取pg数据库报错操作符不存在

2024-08-29 04:39:11

代码:

Properties connectionProperties = new Properties();

connectionProperties.put("user", Constants.PG_USERNAME);

connectionProperties.put("password", Constants.PG_PASSWD);

connectionProperties.put("fetchsize", "10000");

spark.read().jdbc(Constants.PG_JDBC, "tb_grid_export", "google_gci", 2669989, 2682906, 10, connectionProperties)

.write().mode(SaveMode.Overwrite).saveAsTable("tb_grid_export");

原因:

spark并行读取时候,会根据指定的字段和指定的上下限值生成对于的where条件,上下限制要求是数值类型,这里报错的原因是PG库里指定并行的字段存储类型为varchar

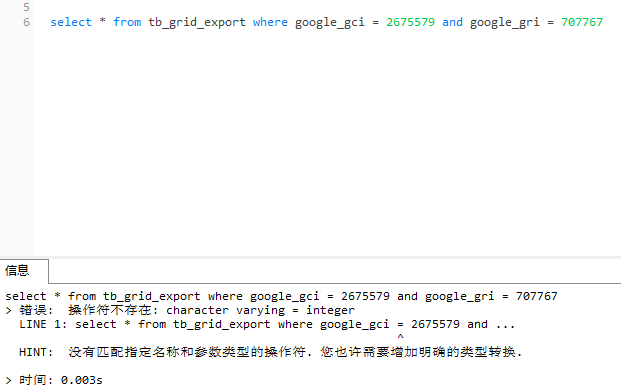

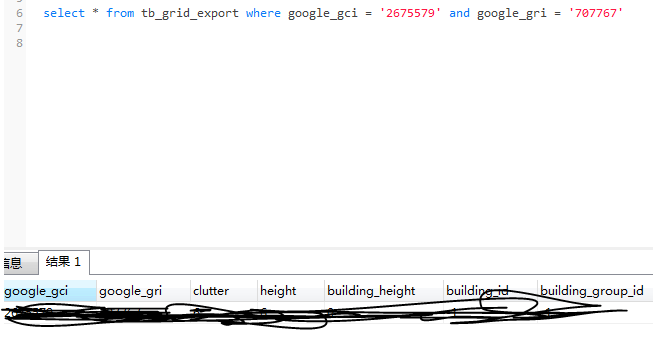

如下测试:

最新文章

- JSP的基本语法

- 关于spark的一些简单认识。

- C#实现http协议下的多线程文件传输

- 与众不同 windows phone (47) - 8.0 其它: 锁屏信息和锁屏背景, 电池状态, 多分辨率, 商店, 内置协议, 快速恢复

- 读书笔记——Windows核心编程(2)比较字符串

- Python: Lambda Functions

- JS动态调用方法名示例介绍

- linux 下 奇怪的 动态库 依赖问题

- linux —— 启动引导程序 lilo 与 grub

- 一封推荐信——android培训机构

- 第七届河南省赛10403: D.山区修路(dp)

- 基于Jmeter的轻量级接口压力测试(一)

- Jenkins2 实现持续交付初次演练(MultiJob,Pipeline,Blue Ocean)

- UWP 邮件反馈

- k8s 如何 Failover?- 每天5分钟玩转 Docker 容器技术(127)

- 4sumii

- 什么是Vagrant

- neo4j-cypher

- C# 设置Excel超链接(二)

- Looping through the content of a file in Bash