关于hadoop多次format之后,会出现的dataNode消失问题

2024-10-07 20:12:11

如标题,最近我由于想初始化以下hadoop集群,之后却发现启动集群后所有的DataNode都消失了。

问题查找:

由于时所有的DataNode都出了问题,于是我翻找了以下DataNode的日志(默认在安装下的logs文件里):

2019-09-21 14:51:16,642 WARN org.apache.hadoop.hdfs.server.common.Storage: Failed to add storage directory [DISK]file:/home/howie/hadoop/dfs/data/

java.io.IOException: Incompatible clusterIDs in /home/howie/hadoop/dfs/data: namenode clusterID = CID-952bba13-0ef1-4383-9985-38c30ecbd500;

datanode clusterID = CID-5d8ae51b-e670-449c-90bb-f676aabe3fef

看出来可能是因为namenode的clusterID与datanode的clusterID不一样而造成的错误,但我并没有看懂,上网查了一下,发现只需要将所有datanode的hdfs的data的目录下的current删除即可。

解决:

于是我决定尝试一下:

rm -rf /home/howie/hadoop/dfs/data/current

#在所有的DataNode下执行

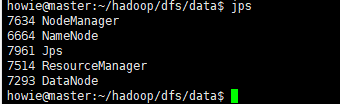

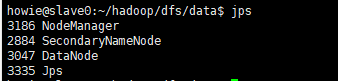

然后该出来的都出来了

最新文章

- 2.5多重else嵌套的二次方程求根

- 启动App的Intent

- C#正则表达式匹配字符串

- Log4net使用(一)

- 单选按钮选中js的处理

- alpha融合

- 2.servlet 生命周期

- java代码整理---正则表达式

- vue实例讲解之vuex的使用

- MyBatis - 介绍、简单入门程序

- SuperMap iObject入门开发系列之五管线属性查询

- 将文件转成clob添加到Oracle数据库中

- PEP 492 -- Coroutines with async and await syntax 翻译

- 3.3《想成为黑客,不知道这些命令行可不行》(Learn Enough Command Line to Be Dangerous)——less即more

- python 基础 元组()

- [python] 基于词云的关键词提取:wordcloud的使用、源码分析、中文词云生成和代码重写

- LINUX 下挂载 exfat 格式 u 盘或移动硬盘

- Javap -c 字节码解析

- 使用web.xml方式加载Spring时,获取Spring context的两种方式

- java日志-纯Java配置使用slf4j配置log4j(转)