Ceph 故障修复记录(持续更新)

2024-10-06 22:41:03

目录

文章目录

问题:故障域与副本数导致的 PG 不正常

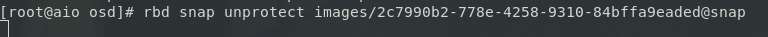

缘起:执行 rbd snap unprotect 执行卡死。

调查:Ceph 集群 PG 不正常。

原因:因为该环境是一个 All-in-one 的环境,CRUSH bucket 默认为 Host 级别,与此同时 Pool: default.rgw.control 的 Replication Size: 3,min_size: 2。在这样的前提下就要求 Ceph 集群中至少必须存在 2 个节点,在数据写入的时候写入到 2 个不同的故障域中,以此来保证高可用特性。

解决:将 Pool: default.rgw.control 的 min_size 设置为 1。

ceph osd pool set default.rgw.control min_size 1

最新文章

- python基础三

- thinkjs中自定义sql语句

- Codeforces Round #157 (Div. 2) D. Little Elephant and Elections(数位DP+枚举)

- JavaBean基本用法示例(一)

- 欧几里得&扩展欧几里得

- Query对象与DOM对象之间的转换方法

- javascript reverse string

- 中文系统下,UTF-8编码文本文件读取导致的错误

- IMP导入数据 报错 IMP-00058 ORA-01691 IMP-00028

- 研究 Javascript的&&和||的另类用法

- hdoj 2544 最短路(最短路+Dijkstrea算法)

- 2012天津E题

- P2024食物链

- java中throw与throws

- 清清楚楚地搭建MongoDB数据库(以搭建4.0.4版本的副本集为例)

- numpy交换列

- Delphi ClientDataSet复制记录

- ajax全局事件

- 【CF526G】Spiders Evil Plan(贪心)

- SQL Server - GO