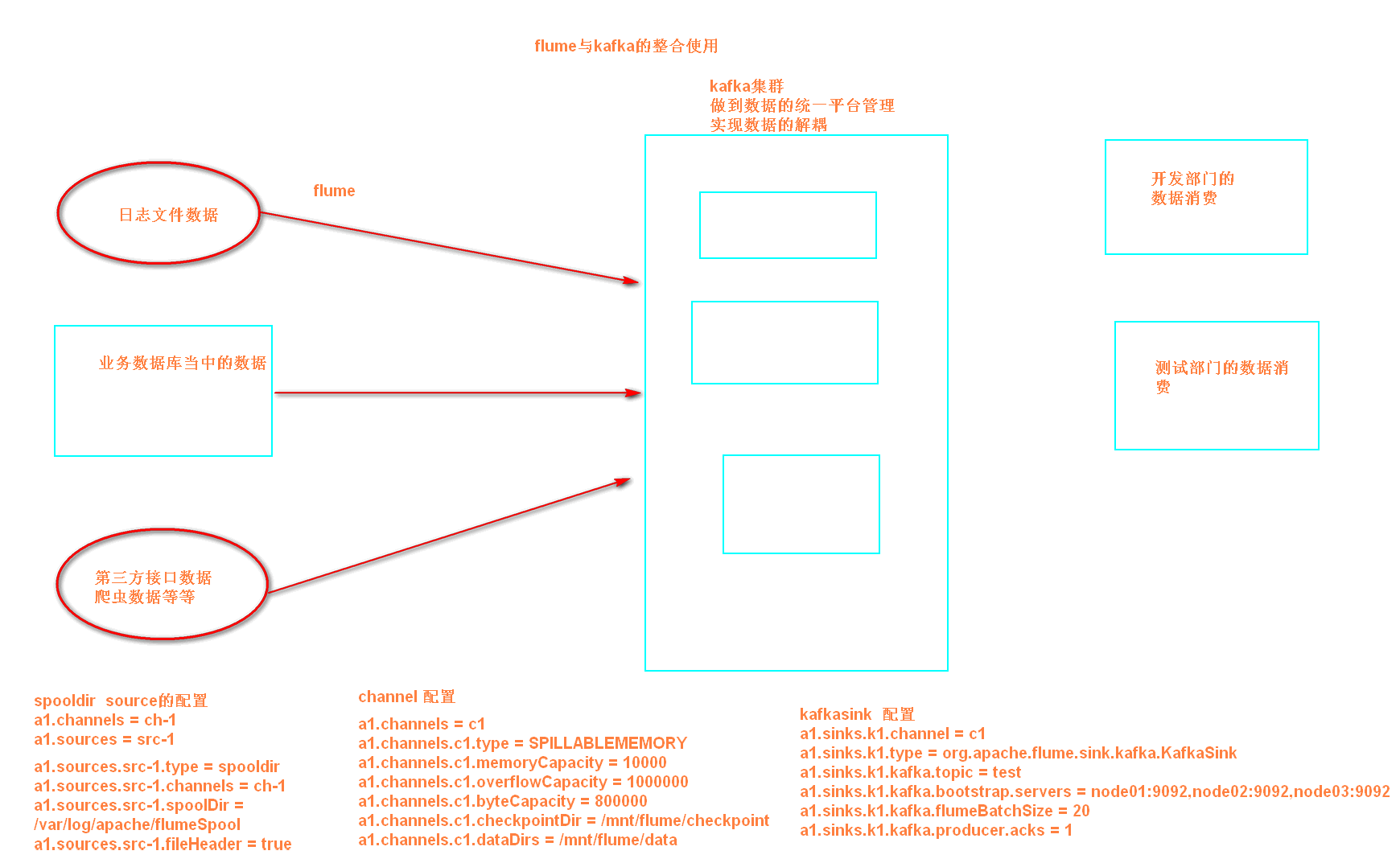

第1节 kafka消息队列:10、flume与kafka的整合使用

11、flume与kafka的整合

实现flume监控某个目录下面的所有文件,然后将文件收集发送到kafka消息系统中

第一步:flume下载地址

http://archive.cloudera.com/cdh5/cdh/5/flume-ng-1.6.0-cdh5.14.0.tar.gz

第二步:上传解压flume

第三步:配置flume.conf

#为我们的source channel sink起名

a1.sources = r1

a1.channels = c1

a1.sinks = k1

#指定我们的source收集到的数据发送到哪个管道

a1.sources.r1.channels = c1

#指定我们的source数据收集策略

a1.sources.r1.type = spooldir

a1.sources.r1.spoolDir = /export/servers/flumedata

a1.sources.r1.deletePolicy = never

a1.sources.r1.fileSuffix = .COMPLETED

a1.sources.r1.ignorePattern = ^(.)*\\.tmp$

a1.sources.r1.inputCharset = GBK

#指定我们的channel为memory,即表示所有的数据都装进memory当中

a1.channels.c1.type = memory

#指定我们的sink为kafka sink,并指定我们的sink从哪个channel当中读取数据

a1.sinks.k1.channel = c1

a1.sinks.k1.type = org.apache.flume.sink.kafka.KafkaSink

a1.sinks.k1.kafka.topic = test

a1.sinks.k1.kafka.bootstrap.servers = node01:9092,node02:9092,node03:9092

a1.sinks.k1.kafka.flumeBatchSize = 20

a1.sinks.k1.kafka.producer.acks = 1

启动flume

bin/flume-ng agent --conf conf --conf-file conf/flume.conf --name a1 -Dflume.root.logger=INFO,console

最新文章

- Thinking in java学习笔记之map的应用

- hibernate 多表查询

- 获取PC或移动设备的所有IP地址

- iis6.0+.net 4.0 +mvc 404错误

- servlet实现文件下载

- ThreadLocal模式探索

- struts2+hibernate-jpa+Spring+maven 整合(1)

- apache 启动不了

- Android 利用剪切板(clipboardManager )实现数据传递

- 【MongoDB数据库】MongoDB 命令入门初探

- windows azure 实例

- IE浏览器审查密码的清除

- Hybris 6.4 + Jrebel

- fildder

- Markdown 使用技巧

- 继上篇后的Excel批量数据导入

- PostgreSQL的SQL语句中的双引号引发的问题

- 启动Jenkins

- Docker—微软微服务

- layer弹出相册层