Adam Optimization Algorithm

2024-09-06 00:02:43

曾经多次看到别人说起,在选择Optimizer的时候默认就选Adam。这样的建议其实比较尴尬,如果有一点科学精神的人,其实就会想问为什么,并搞懂这一切,这也是我开这个Optimizer系列的原因之一。前面介绍了Momentum,也介绍了RMSProp,其实Adam就是二者的结合,再加上偏差修正(Bias Correction)。

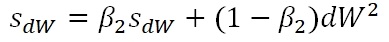

首先,在Adam算法迭代过程中,需要计算各个时刻梯度的Exponential Moving Average,这一步骤来源于Momentum算法:

第二,计算各个时刻梯度平方的Exponential Moving Average,这一步骤来源于RMSProp算法:

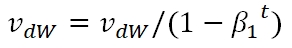

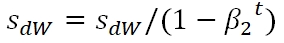

第三步,分别对二者最Bias Correction:

最后,将算法合并:

最新文章

- nginx $document_uri 防止死循环

- 基于WS-BPEL2.0的服务组合研究

- gulp进阶构建项目由浅入深

- 网站为什么要做SEO

- Uva401Palindromes

- 点餐APP 冲刺一总结

- Linux 本地文件或文件夹上传服务器

- java spring 框架学习

- Codeforces Round #221 (Div. 2) C. Divisible by Seven(构造 大数除法 )

- eclipse中调出android sdk manager和android virtual device manager图标

- SMT贴片红胶基本知识

- DHot.exe 热点新闻

- rpm打包工具---FPM

- Python文件学习

- Codeforces1062C. Banh-mi(贪心+快速幂)

- Python-初识模块

- 018_nginx_proxy死循环问题

- 最大流最小割学习 基本知识 | 证明 | FF算法

- DFS遍历中forward、backward以及cross边的界定

- 异步FIFO格雷码与空满