Java中HashMap与ConcurrentHashMap的区别

从JDK1.2起,就有了HashMap,正如前一篇文章所说,HashMap不是线程安全的,因此多线程操作时需要格外小心。

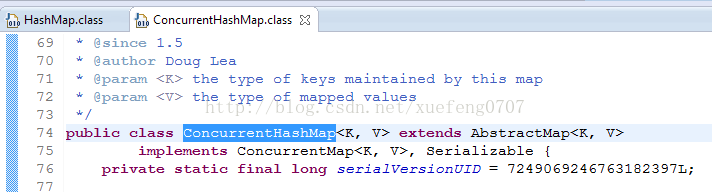

在JDK1.5中,伟大的Doug Lea给我们带来了concurrent包,从此Map也有安全的了。

ConcurrentHashMap具体是怎么实现线程安全的呢,肯定不可能是每个方法加synchronized,那样就变成了HashTable。

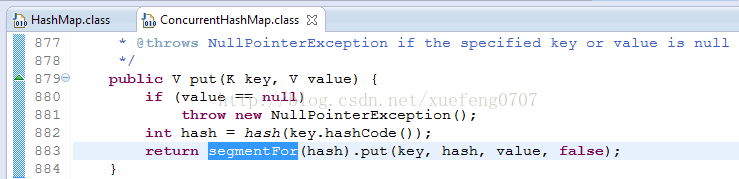

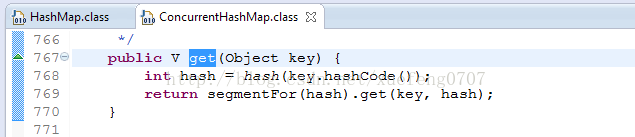

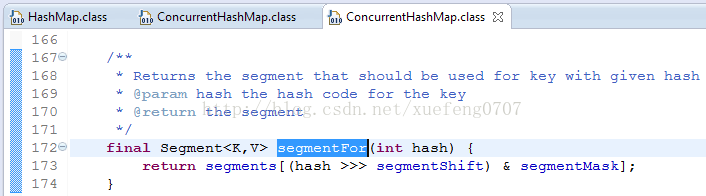

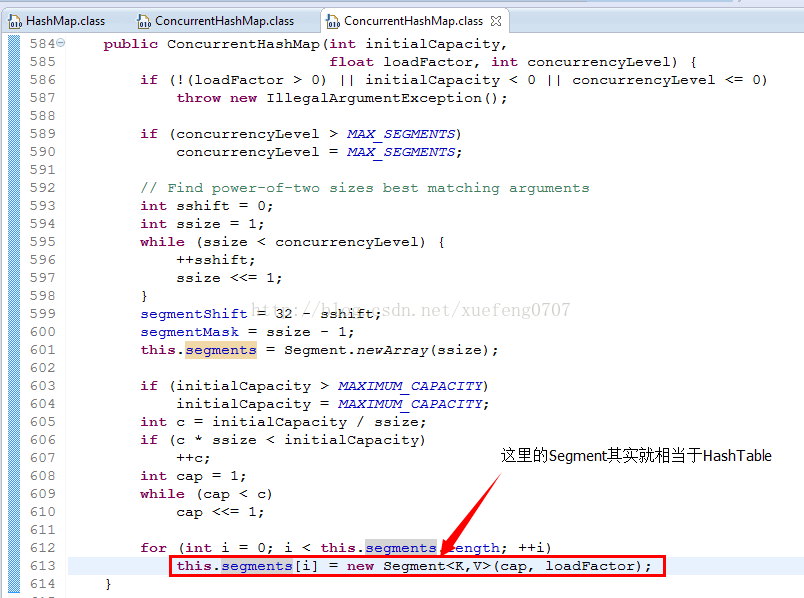

从ConcurrentHashMap代码中可以看出,它引入了一个“分段锁”的概念,具体可以理解为把一个大的Map拆分成N个小的HashTable,根据key.hashCode()来决定把key放到哪个HashTable中。

在ConcurrentHashMap中,就是把Map分成了N个Segment,put和get的时候,都是现根据key.hashCode()算出放到哪个Segment中:

测试程序:

import java.util.concurrent.ConcurrentHashMap;

public class ConcurrentHashMapTest {

private static ConcurrentHashMap<Integer, Integer> map = new ConcurrentHashMap<Integer, Integer>();

public static void main(String[] args) {

new Thread("Thread1"){

@Override

public void run() {

map.put(3, 33);

}

};

new Thread("Thread2"){

@Override

public void run() {

map.put(4, 44);

}

};

new Thread("Thread3"){

@Override

public void run() {

map.put(7, 77);

}

};

System.out.println(map);

}

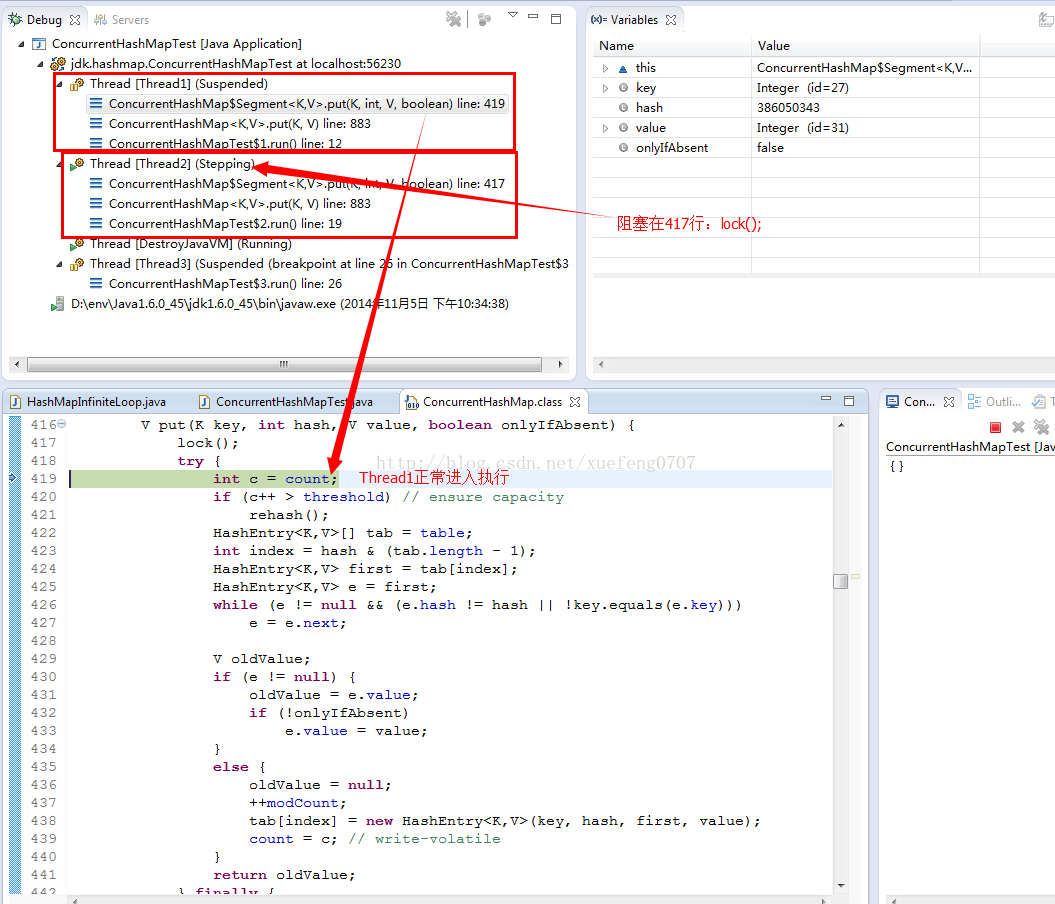

}ConcurrentHashMap中默认是把segments初始化为长度为16的数组。根据ConcurrentHashMap.segmentFor的算法,3、4对应的Segment都是segments[1],7对应的Segment是segments[12]。(1)Thread1和Thread2先后进入Segment.put方法时,Thread1会首先获取到锁,可以进入,而Thread2则会阻塞在锁上:

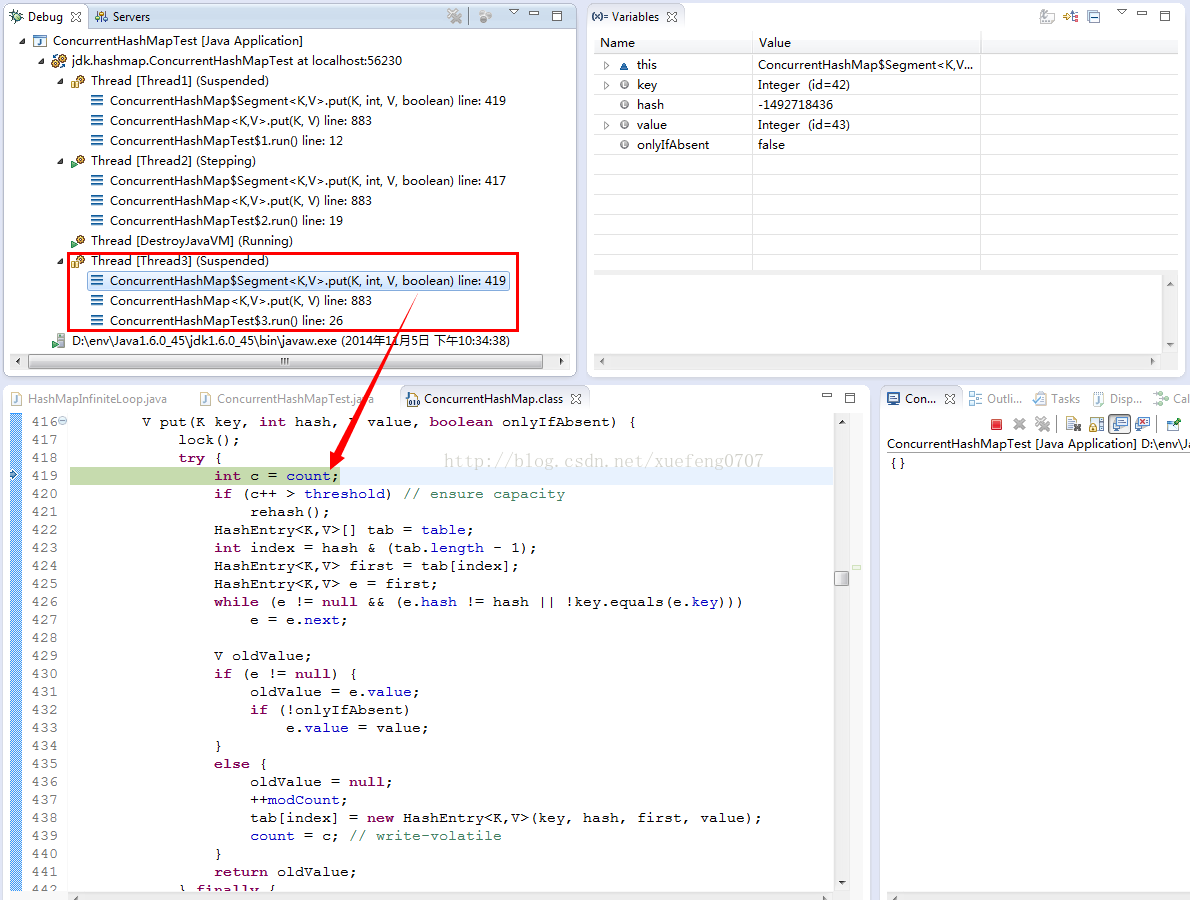

(2)切换到Thread3,也走到Segment.put方法,因为7所存储的Segment和3、4不同,因此,不会阻塞在lock():

以上就是ConcurrentHashMap的工作机制,通过把整个Map分为N个Segment(类似HashTable),可以提供相同的线程安全,但是效率提升N倍,默认提升16倍。

最新文章

- 基于Calabash-andriod的UI自动化测试(1)-环境和原理

- 调试一个socket通信bug的心理过程和反思

- css常用公共样式

- mysql数据导入

- C# 4.0 并行计算部分

- Access SQL实现连续及不连续Rank排名

- PE解析器的编写(三)——区块表的解析

- putty,xshell以及密钥认证:linux学习第二篇

- 【iOS】OC-时间转化的时区问题

- 从PRISM开始学WPF(五)MVVM(一)ViewModel?

- getgpc($k, $t='GP'),怎么返回的是 NULL?

- centos6.5 配置静态IP

- Java 扫描实现 Ioc 动态注入,过滤器根据访问url调用自定义注解标记的类及其方法

- shell生成rsync同步脚本

- 在 ASP.NET Core 中发送邮件遇到的坑_学习笔记

- Ubungu 18.04安装MySQL 5.7.24

- vue 组件之间 的通信

- mysql 聚合函数

- 日志模块logging介绍

- FourAndSix: 2.01靶机入侵